Le terme algorithme peut être défini comme un ensemble d’instructions conçu pour résoudre un type de problème donné. Au niveau de Google, les algorithmes sont un système mis en place pour rechercher et fournir les meilleurs résultats par rapport à une requête.

Pour mieux répondre à toutes les questions qui lui sont soumises et satisfaire les internautes, le moteur de recherche Google améliore autant que possible son système.

Notamment, grâce aux différentes mises à jour et amélioration des algorithmes au niveau de son moteur de recherche.

Mais :

- Qu’est-ce qu’un algorithme ?

- Quel est son utilité pour Google ?

- Comment fonctionne-t-il ?

- Quels sont les principaux algorithmes de Google ?

Voilà autant de questions que j’aborderai dans les lignes suivantes.

Chapitre 1 : Que signifie un algorithme et pourquoi est- il nécessaire ?

Ici, je reviens sur l’explication des algorithmes tout en mettant l’accent sur leur utilité.

1.1. Que signifie la notion d’algorithme ?

Lorsque vous tapez une requête dans la barre de recherche, vous vous attendez à un résultat.

Mais puisque vous ne pouvez pas rechercher vous même l’information, un certain nombre d’instructions à été mis en place.

Ainsi, à partir du moment où vous tapez votre requête, les mots-clés qu’elle contient sont utilisés pour rechercher et classer de façon pertinente les pages web qui traitent de votre question.

Comme vous vous en doutez, ces différentes instructions sont exécutées à l’aide des algorithmes.

Au niveau de Google, les algorithmes recherchent non seulement les pages web qui cadrent avec votre réponse, mais aussi, ils leur attribuent un rang.

Ainsi, celles qui sont les mieux notées sont placées en première position dans les SERPs.

La conséquence directe de ce classement est sans doute l’augmentation du trafic organique vers les sites qui occupent les premières places.

Notez cependant que ce classement n’est pas anodin. Il est en effet régi par un processus. Avant d’aborder ce processus, laissez-moi vous expliquer l’importance des algorithmes.

1.2. Pourquoi les algorithmes sont nécessaires ?

Pour comprendre l’utilité des différents algorithmes que Google à mis en place, il convient de se référer aux objectifs qu’il poursuit. En effet, le moteur de recherche en améliorant régulièrement ces algorithmes espère :

1.2.1. Améliorer la recherche

Puisque les besoins des utilisateurs ne demeurent pas statiques, et changent au fur et à mesure dans le temps, il est nécessaire que la recherche réponde à ces nouveaux besoins.

C’est justement ce que font les algorithmes de Google. Ils permettent à Google d’apporter facilement de nouvelles innovations et facilitent la recherche sur internet.

De même, ces algorithmes participent à la résolution des difficultés qui pourraient empêcher les utilisateurs de trouver des informations pertinentes.

C’est le cas par exemple de la mise à jour Panda qui lutte contre les sites qui ne proposent pas de contenus de qualité.

1.2.2. Afficher des contenus de qualité

Au fur et à mesure que la recherche évolue, Google juge nécessaire d’élargir les facteurs sur lesquels il se base pour classer les sites internet.

Désormais, il n’est plus question d’établir la pertinence d’un site à partir des liens qui pointent vers lui. Il faudrait également regarder la qualité du contenu que ce site produit et d’autres facteurs.

Pour permettre à tout le monde d’être sur la même longueur d’onde quant au sens du contenu de qualité, Google a donné des instructions aux webmasters à travers un article qui expliquent ce que c’est qu’un contenu de qualité.

L’article ira plus loin en recommandant certaines pratiques, mais aussi, en prohibant d’autres.

1.2.3. Tenir compte de l’expérience utilisateurs

En améliorant la recherche et en mettant l’accent sur la création d’un contenu de qualité, Google entend répondre de manière satisfaisante aux questions de l’internaute.

Cependant, il faudrait également tenir compte de l’intention de recherche et du contexte dans lequel l’internaute effectue sa recherche.

C’est pourquoi, l’affichage des résultats de recherche sont également influencer par :

- L’emplacement ;

- La langue ;

- Les recherches précédentes ;

- L’appareil utilisé ;

- Etc.

A juste titre, on remarque que les résultats s’affichent différemment d’un endroit à un autre.

Quoi qu’il en soit, on comprend que Google fait tout pour offrir des résultats qui soient :

- Trouvables ;

- Accessibles ;

- Pertinentes ;

- Et utilisables.

À présent que vous savez ce que c’est qu’un algorithme et pourquoi ils sont mis en place au niveau du moteur de recherche Google, je vous invite à connaître leur fonctionnement.

Chapitre 2 : Comment les algorithmes contribuent à la recherche Google ?

Dans ce chapitre, je vous présente le fonctionnement des algorithmes Google à travers les différentes étapes de l’affichage d’une requête au niveau des moteurs de recherche.

Voici les différentes étapes qui interviennent dans l’affichage des résultats de recherche :

2.1. L’analyse des mots de recherche

La première étape dans le processus d’affichage des résultats de recherche est la compréhension par le moteur de recherche des termes de votre requête.

L’objectif est de comprendre le sens de chaque terme que vous utilisez, mais aussi d’identifier les pages web qui correspondent.

Pour réussir cela, Google a mis en place une pluralité de techniques d’interprétation. Il s’agit par exemple de :

- L’interprétation automatique des fautes d’orthographe ou traitement automatique du langage naturel ;

- Le système de gestion des synonymes pour faciliter l’analyse des requêtes ayant plusieurs sens ;

- L’usage de certains mots spécifiques dans votre requête ;

- Etc.

2.2. La recherche d’une correspondance entre la requête et les éléments de l’indexe

Une fois que l’analyse des mots contenus dans votre requête à été comprise par le moteur de recherche, il détermine les pages dont le contenu correspond à votre requête.

Notamment en recherchant :

- Le nombre de fois où les mots les plus importants de votre requête apparaissent sur les pages ;

- La façon dont ils sont positionnés sur chacune des pages.

En effet, Google part de l’hypothèse selon laquelle la présence des mots clés contenu dans votre requête sur une page indique la présence d’informations liées à votre requête.

Mais ce n’est pas tout, Google utilise également des données d’interactions globales et anonymes pour évaluer l’intérêt des résultats.

Ces données sont par la suite transformées en signaux puis évaluées grâce aux systèmes de machine learning. Pour tout dire, le géant américain fait de son mieux pour identifier les contenus qui sont rédigés dans le langage de votre question.

2.3. Le classement des pages selon leur importance

Pour une requête, il existe probablement des milliers de contenus qui pourraient vous intéresser. Mais l’objectif étant de vous proposer les meilleurs résultats, Google procède à un classement.

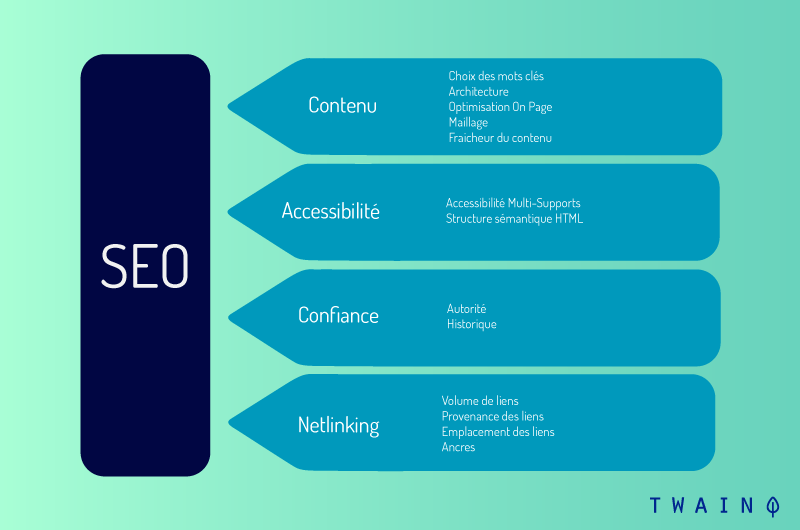

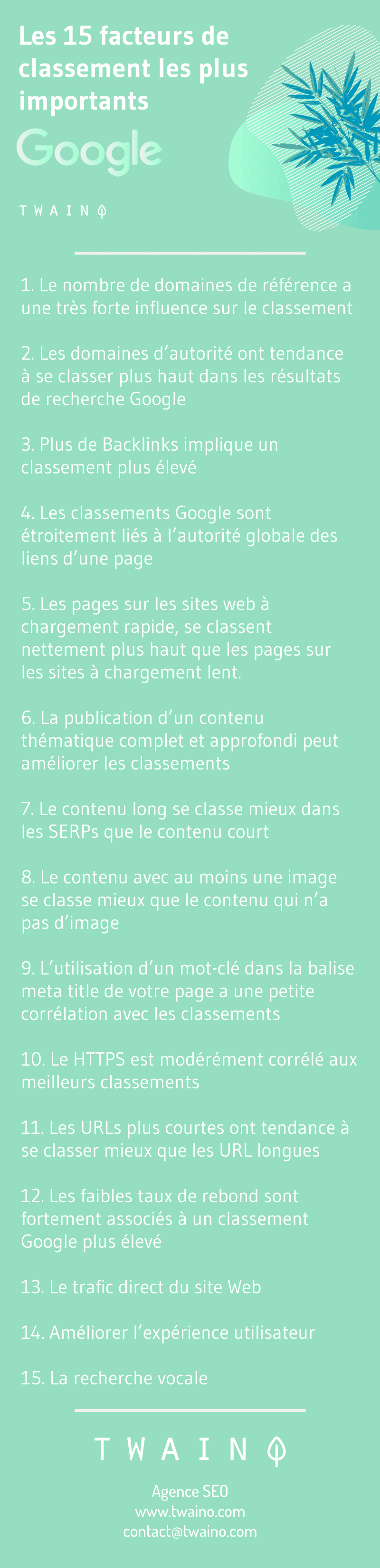

En effet, sur la base de plus de 200 critères, le moteur de recherche identifie les meilleures pages en rapport à votre recherche.

Ces critères concernent entre autres :

- Le niveau d’actualisation de la page ;

- L’ergonomie de la page ;

- Le nombre d’internautes qui visitent et accorde du crédit à la page ;

- Les liens que la page a obtenus sur d’autres sites.

Le moteur de recherche accorde une grande importance à tous ces critères et c’est pour cette raison qu’il n’hésite pas à partager avec les webmasters les consignes ainsi que les informations nécessaires dont ils ont besoin.

2.4. La sélection des meilleurs résultats

À partir du moment où les pages les plus pertinentes sont sélectionnées, Google identifie si ces pages répondent effectivement à la requête de l’utilisateur.

Il vérifie aussi si ces pages donnent une interprétation réductrice du sujet pour proposer des éléments non seulement dans les formats de votre recherche, mais aussi une pluralité d’informations en rapport avec votre sujet.

Retenez aussi à ce niveau que tout n’est pas basé sur le contenu, car le moteur de recherche vérifie si le site est conçu pour offrir une bonne expérience utilisateur.

2.5. L’affichage selon le contexte dans lequel la recherche à été effectuée

Vous l’auriez constater, la plupart des résultats Google s’affichent :

- En fonction de votre zone géographique ;

- Selon vos paramètres de recherche ;

- Ou encore sur la base de vos récentes activités de recherche.

C’est en réalité pour cela que les résultats de recherche s’affichent différemment selon que vous effectuez la recherche aux États-Unis où en France.

Il apparaît donc évident que tout le monde n’obtient pas les mêmes résultats de recherche même s’ils tapent exactement les mêmes mots-clés.

Maintenant que vous en savez un peu plus sur la façon dont les algorithmes aident le traitement des réponses au niveau du moteur de recherche, découvrez dans le chapitre suivant quelques algorithmes Google.

Chapitre 3 : Quelques algorithmes de Google

Dans ce chapitre, je vous présente une liste des différents algorithmes Google. Elle n’est évidemment pas exhaustive parce qu’on ne connaît pas tous les composants du moteur de recherche.

3.1. Caffeine

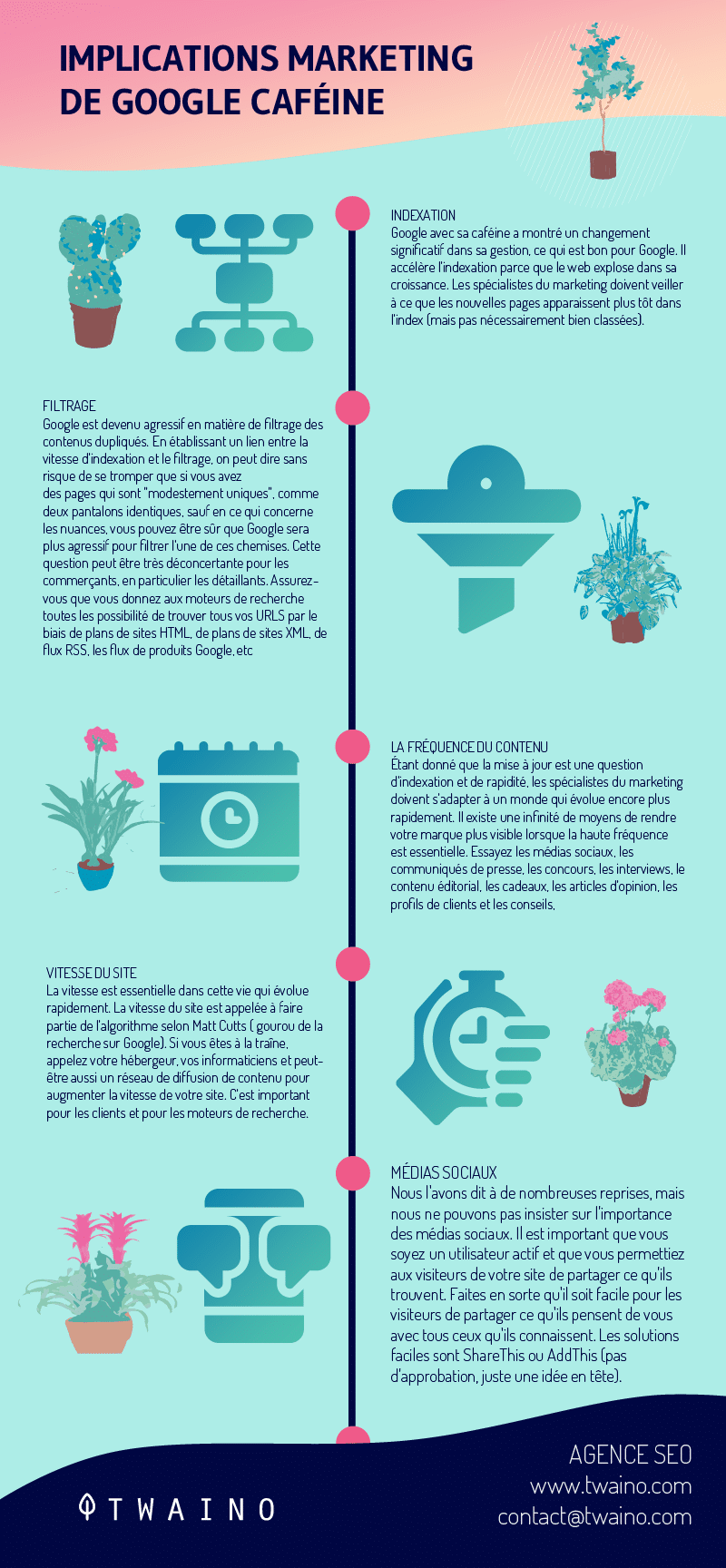

Sortie en Août 2009, la mise à jour caféine consacre l’exploration et l’indexation quasi-instantanée des pages web. Il permet ainsi à Google de proposer des contenus plus récents.

Pour mieux comprendre cette mise à jour, il faut porter un regard sur l’évolution d’internet.

En effet, au moment de la conception du système d’indexation initial de Google, il y avait peu de sites internet et seulement 188 millions de personnes qui consultaient internet.

Cependant, en 2009, il y avait 100 fois plus de sites Web et près de 1,8 milliard de personnes qui accédaient à internet.

En dehors de l’évolution d’internet, il y a aussi, les nouvelles changements induits par l’émergence d’autres formes de contenu comme :

- Les vidéos ;

- Les images ;

- Autres données.

C’est pourquoi Google a introduit cette mise à jour avec les implications suivantes :

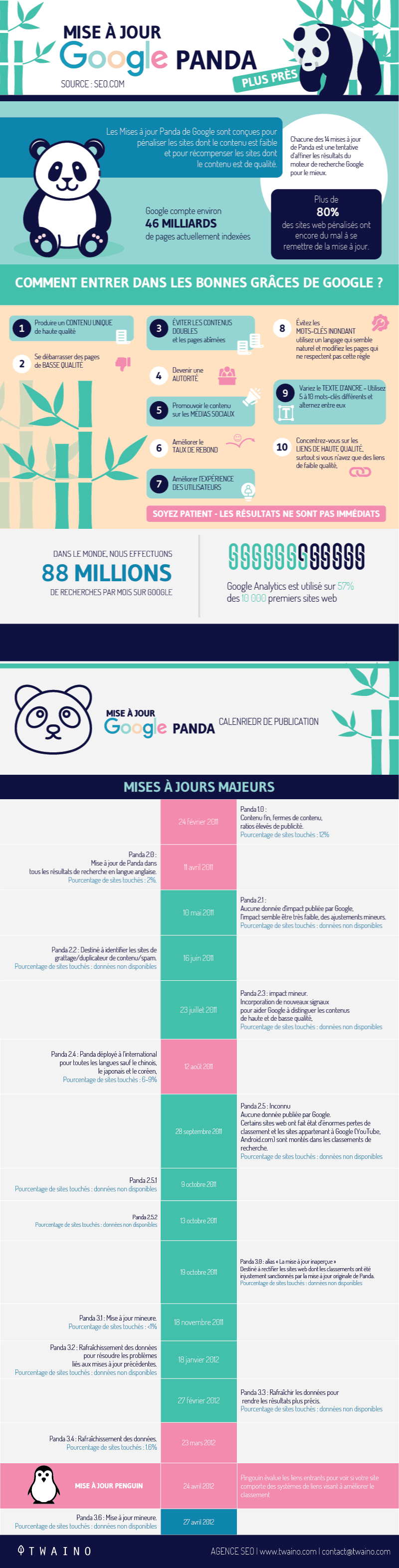

3.2. La mise à jour Panda

Sortie en 2011, la mise à jour Panda lutte contre :

- Les sites dont les contenus sont de mauvaises qualités ;

- Les sites qui proposent des contenus sur-optimisés ;

- Les sites qui génèrent automatiquement de contenus ;

- Les agrégateurs de contenu ;

- Etc.

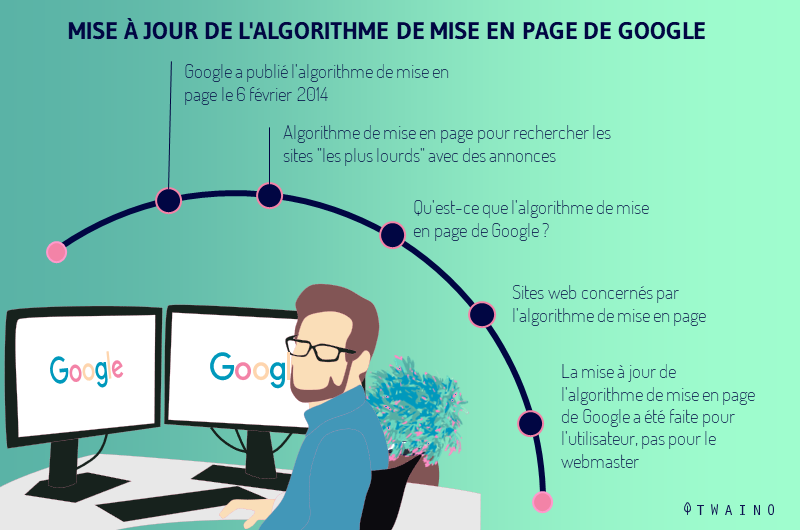

3.3. Top Heavy

L’algorithme Top Heavy a été déployé en janvier 2012 pour pénaliser les sites qui surchargent leur ligne de flottaison.

Notez cependant qu’il s’agit d’une mise à jour mineure et qu’ elle n’a eu un impact que sur 1% des résultats de recherche.

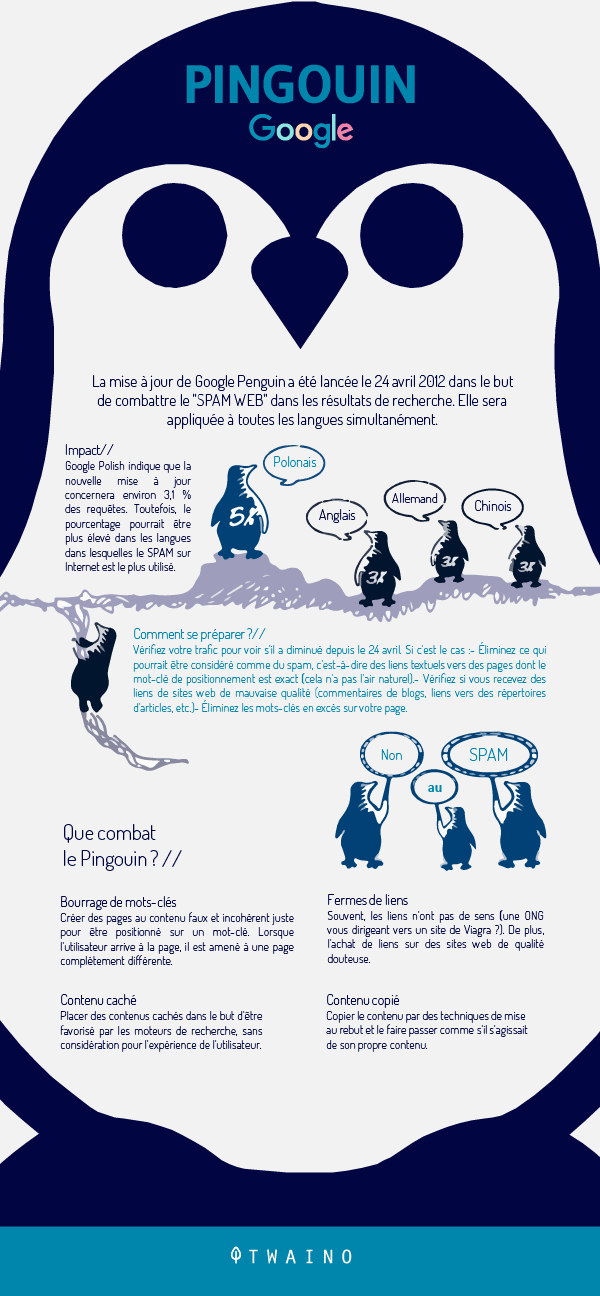

3.4. Penguin

Lancée en 2012, la mise à jour penguin permet de sanctionner les sites qui adoptent de mauvaises pratiques en matière d’acquisition de liens ou pour tromper les moteurs de recherche.

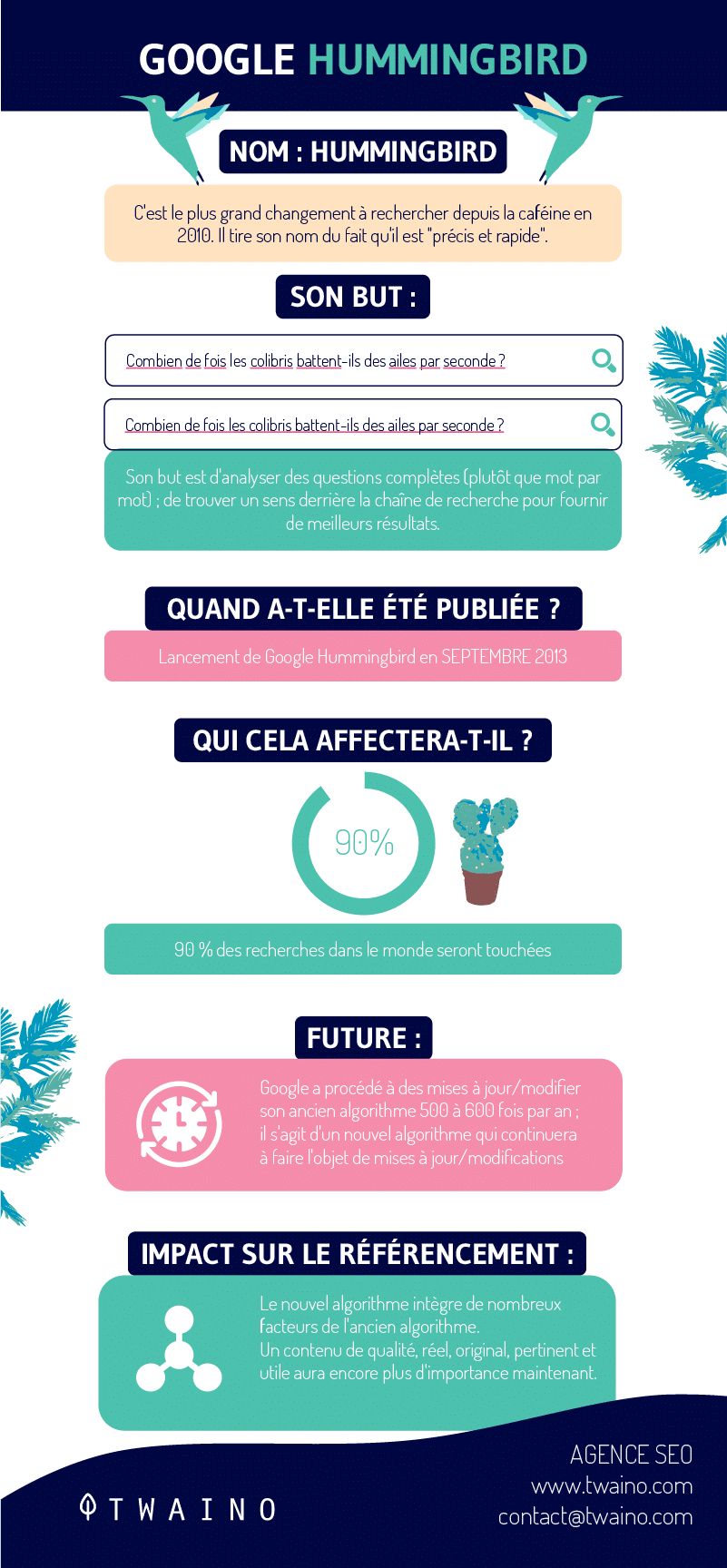

3.5. Colibri

Colibri ou Hummingbird accorde plus d’importance à la compréhension de chaque mot présent dans une requête.

En lançant cette mise à jour en 2013, Google s’assure que c’est la phrase de recherche entière et non des mots en particuliers qui sont pris en compte.

L’ambition est de comprendre correctement la requête de l’utilisateur pour lui afficher la réponse la plus pertinente plutôt qu’une simple liste de résultats comportant des termes de sa requête.

Hummingbird permet aussi au géant moteur de recherche de poser les bases de la recherche vocale qui devenait peu à peu importante. Ceci notamment en raison de son intégration à certains appareils grâce aux outils comme :

- Google Home ;

- Alexa ;

- Siri ;

- Etc.

Quoi qu’il en soit, il faut reconnaître que la mise à jour Hummingbird n’est pas spécialement destinée à pénaliser les sites d’une quelconque mauvaise pratique.

Elle mettait cependant l’accent sur :

- L’importance de disposer d’une copie SEO lisible ;

- L’utilisation d’un langage naturel ;

- L’utilisation du champ sémantique pour les mots-clés plutôt que la sur-optimisation des mots-clés.

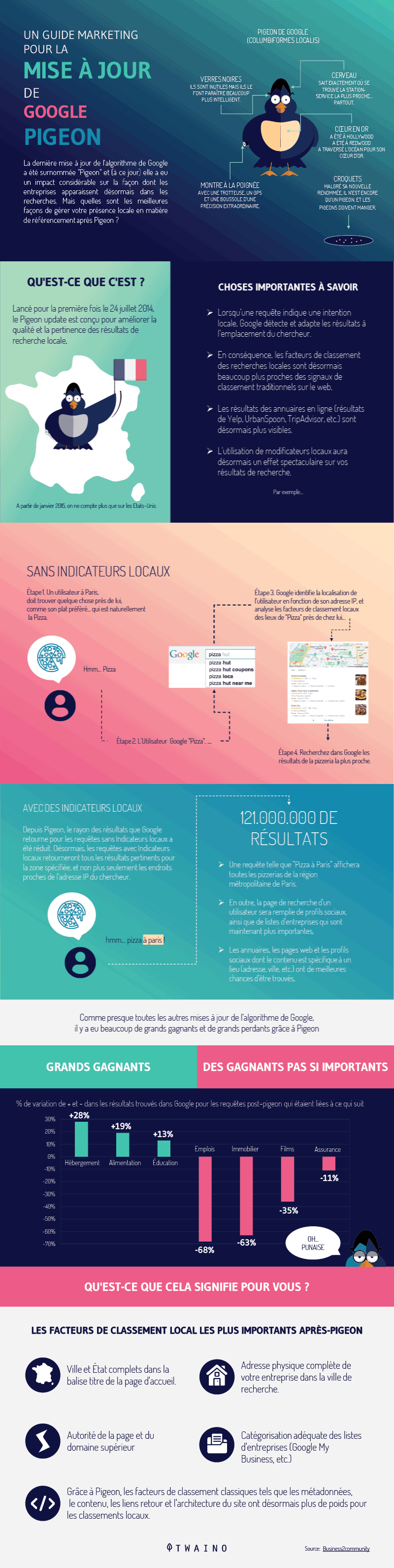

3.6. Pigeon

Pigeon est le nom de la modification de l’algorithme Google qui s’intéresse à la recherche locale. Il a été déployé en 2014 et affecte essentiellement les pages de résultats ainsi que Google Maps.

L’objectif était bien entendu de rendre les résultats locaux plus pertinents et de meilleure qualité.

Mais aussi, il est question de tenir compte des facteurs de classement biologique.

La mise à jour Pigeon a donné lieu à une localisation plus précise qui donne l’avantage d’affichage dans les SERPs, des sites ou entreprises qui se trouvent à proximité de l’emplacement de l’utilisateur.

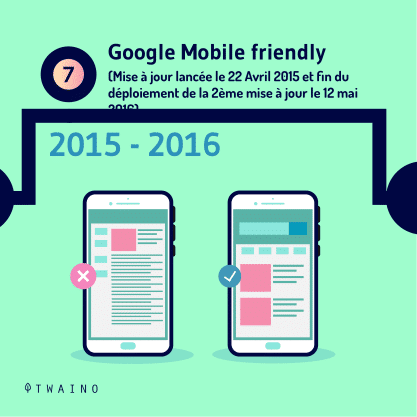

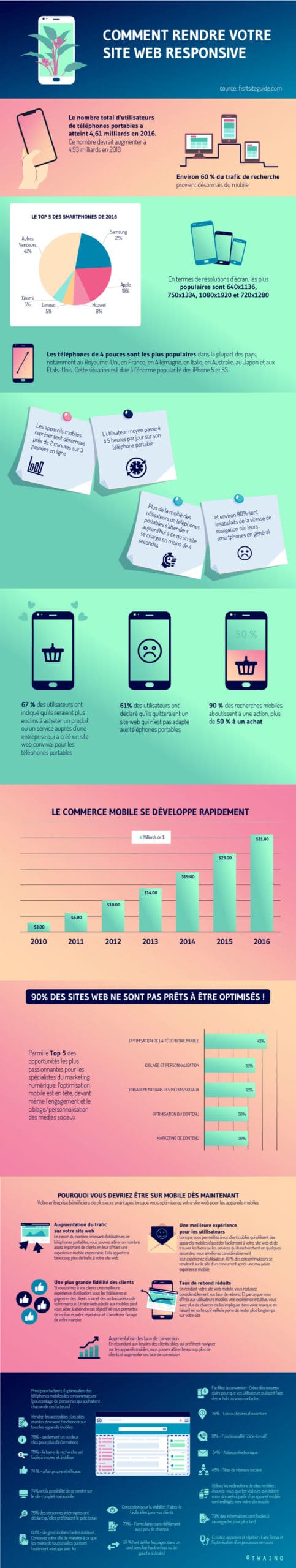

3.7. La mise à jour Mobile friendly

L’industrie du référencement a surnommé cette mise à jour de Google « Mobilegeddon » car elle pensait que cela bouleverserait totalement les résultats de la recherche.

En 2015, plus de 50% des requêtes de recherche de Google provenaient déjà d’appareils mobiles. Cela a conduit ce moteur de recherche à donner l’avantage de classement aux sites web qui sont adaptés à un affichage mobile.

Google a par ailleurs conçu un guide pour aider les webmasters en général et les débutants en particulier à optimiser leur site pour mobile.

3.8. Google Quality ou Phantom

L’algorithme Google Quality ou Phantom évalue la qualité des sites internet et pénalise ceux dont le contenu ne présente aucun intérêt pour les internautes de même que ceux dont le but est d’afficher juste de la publicité.

Même si l’algorithme a été déployé pour la première fois en 2013, il convient de rappeler que c’est en mai 2015 que Google a officiellement communiqué sur ce dernier.

Le nom Phantom donner à l’algorithme vient du fait qu’aucune annonce officielle n’a été faite par Google.

Les webmasters ont juste remarqué des changements significatifs dans les SERPs et étaient convaincus que quelque chose s’était produit.

En effet, il apparaissait que les sites présentant les traits suivants perdaient du trafic ou régressent dans les SERPs :

- Un contenu de mauvaise qualité ;

- Un contenu créé juste pour avoir des clics ;

- Beaucoup de publicités sur les pages ;

- Les sites avec beaucoup de pages affichant les « erreurs 404 ».

Ce n’est qu’après quelques semaines que Google à confirmer qu’une mise à jour avait été déployée et qu’elle portait bien entendu sur la qualité des contenus sur internet.

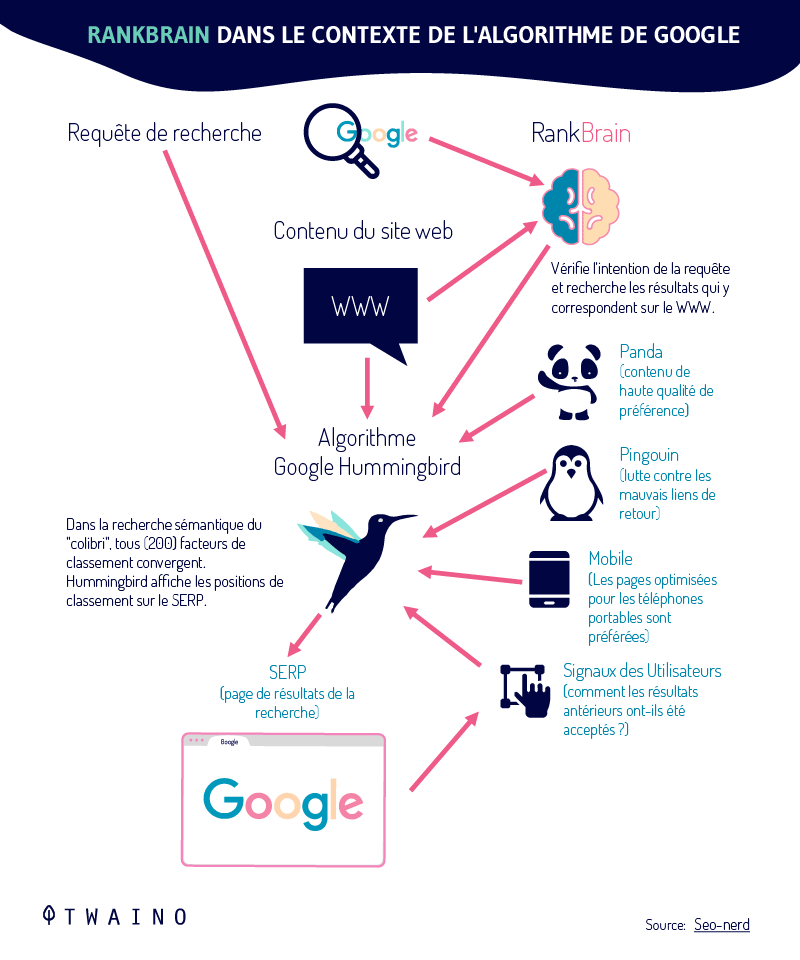

3.9. RankBrain

Dans l’optique d’afficher toujours les meilleurs résultats aux internautes, RankBrain a été conçue.

Il s’agit d’un système d’intelligence artificielle qui vise à aider le moteur de recherche Google à analyser et comprendre les requêtes complexes qui lui sont adressées.

L’algorithme RankBrain repose sur les systèmes de machine learning et du deep learning, tous deux des technologies d’apprentissage automatique.

La machine learning est un système d’apprentissage automatique. Il se trouve au cœur des recherches sur l’analyse prédictive. Il permet de lier une grande masse d’informations et de données avec des algorithmes pour un but précis.

Le Deep learning correspond quant à lui à la faculté que la machine a d’apprendre non seulement par elle-même, mais aussi de façon plus approfondie. Il correspond également à la faculté dont la machine dispose pour reconnaître certains éléments comme une voix ou une image.

Ces deux technologies mises ensemble permettent au moteur de recherche d’établir des connexions entre les requêtes de l’internaute et de construire des liens entre les mots contenus dans les longues requêtes.

Ceci permet par exemple à Google d’afficher des pages qui ne comportent pas les mots de la requête de l’internaute, mais qui répondent à la question posée.

Le lancement de Rankbrain est une étape importante pour le moteur de recherche, car désormais il peut mieux déchiffrer le sens des recherches et fournir les meilleurs résultats.

En mars 2016, Google a révélé que RankBrain était l’un des trois signaux de classement les plus importants.

À l’opposé des autres critères de classement des résultats de recherche, vous ne pouvez pas optimiser votre site pour RankBrain.

Il est plutôt recommandé de rédiger des contenus de qualité afin de pouvoir optimiser votre site pour ce critère.

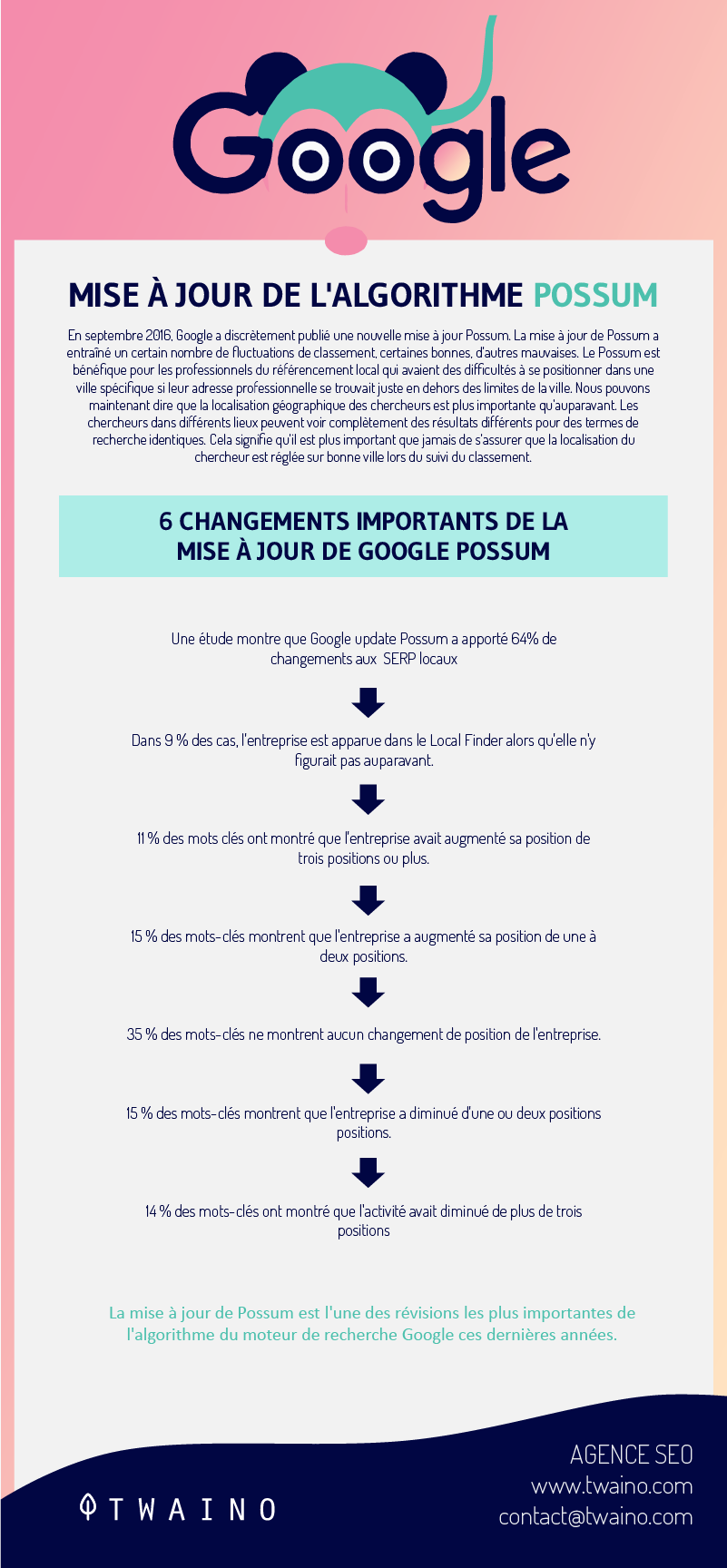

3.10. Possum

Lancée en 2016, l’algorithme Possum permet à Google d’améliorer encore plus sa stratégie de référencement local.

Plusieurs modifications étaient apportées au filtre de classement local. De plus, cette mise à jour consacre l’indépendance de la recherche locale vis à vis des résultats organiques.

Avec l’avènement de la mise à jour Possum, les résultats de la recherche locale s’affichent en fonction des facteurs comme :

- L’emplacement physique de l’internaute ;

- La formulation de la requête ;

- Etc.

On note également :

- L’affichage d’un “pack 3” dans les résultats de recherche ;

- L’affichage des résultats locaux sur l’interface de Google maps.

L’impact de la mise à jour Possum sur le référencement est tel qu’elle a induit la nécessité pour les entreprises d’attacher une grande importance à leur référencement local.

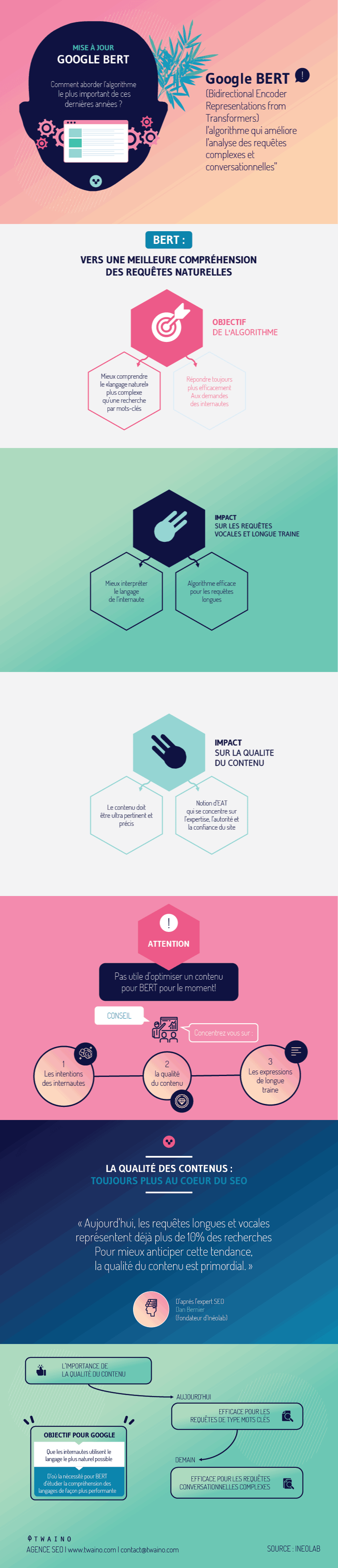

3.11. BERT

La mise à jour BERT de Google a été annoncée comme le plus grand changement opéré par Google sur les cinq dernières années.

Il s’agit aussi d’un algorithme d’apprentissage automatique. Il est basé sur un réseau neuronal qui assure le traitement du langage naturel (NLP). Le nom BERT est l’abréviation de : Bidirectional Encoder Representations from Transformers.

La mise à jour BERT donne la capacité au moteur de recherche de comprendre le contexte complet d’un mot à partir des mots qui viennent avant et après.

De façon concrète, l’algorithme utilise le contexte et les relations de tous les mots contenus dans une phrase.

Comme vous l’imaginez, cette mise à jour consacre une grande amélioration de l’interprétation des termes de recherche et de l’intention qui la sous-tend.

Chapitre 4 : FAQ sur Google Algorithme

4.1. C’est quoi un algorithme en informatique ?

En mathématiques ou en informatique, un algorithme est considéré comme une séquence finie d’instructions bien définie (qui peuvent être implémentées dans un ordinateur), dont le but est de résoudre un ensemble de problèmes donnés ou effectuer des calculs.

Les instructions définies sont claires et sont spécifiées pour effectuer non seulement des calculs, mais aussi le traitement des données, le raisonnement automatique et d’autres tâches.

4.3. Qu’est-ce qui différencie un algorithme d’un programme informatique ?

Il n‘y a généralement pas une grande différence entre les deux. Un programme informatique est un lot d’instructions exécutées par l’ordinateur pour répondre aux problèmes qui lui sont posés.

Un algorithme quant à lui est un ensemble d’opérations bien ordonnées, c’est-à-dire une chaîne d’instructions précises qui doivent être suivies et exécutées suivant un ordre.

4.4. Pourquoi ce mot est-il toujours associé à l’informatique, en particulier aux ordinateurs ?

C’est simple, car les algorithmes sont avant tout un ensemble de méthodes utilisées par les ordinateurs pour résoudre des problèmes.

4.5. Comment fonctionne l’algorithme de Google ?

L’algorithme de Google fait tout le travail qu’il faut à la place de l’internaute en recherchant des pages Web contenant les mots-clés utilisés pour la recherche, puis en attribuant un classement à chaque page en fonction de divers facteurs, notamment le nombre de fois où le mot-clé apparaît sur la page.

4.6. Comment Google réussit-il exactement à trouver les résultats pertinents pour chaque requête aussi rapidement que possible ?

Le poumon de la technologie de recherche de Google est PigeonRank. Ce dernier est un système de classement des pages Web développé par les fondateurs de Google Larry Page et Sergey Brin.

Sur la base des travaux révolutionnaires de BF Skinner, Page et Brin ont jugé bon que des grappes de pigeons (PC) à coût faible peuvent calculer la valeur relative des pages Web plus rapidement qu’un éditeur humain ou des algorithmes basés sur la machine.

En résumé

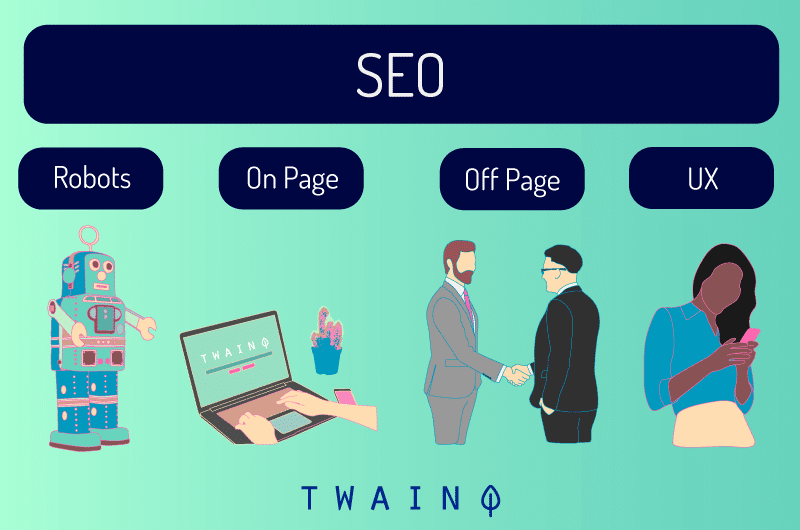

Les algorithmes de Google peuvent être perçues comme des modalités de fonctionnement du moteur de recherche pour afficher des résultats de recherche pertinents.

Ils sont nombreux et évolutifs. Ils pénalisent ou favorisent les sites selon que ces sites respectent ou non les consignes de qualité édictées par Google.

Veillez donc à rester au courant de leur évolution et respecter les implications qu’ils apportent afin d’augmenter les performances de votre site dans les résultats de recherche.

Dans cet article, j’ai abordé non seulement ce qu’est un algorithme, mais aussi la façon dont il intervient dans la recherche Google.

Vous découvrirez également une liste non exhaustive des principaux algorithmes de Google.

J’espère que ce contenu vous aura aidé dans vos recherches et n’hésitez pas à laisser vos questions en commentaire, si vous en avez.