Sejamos francos! Qualquer mudança que os motores de busca, especialmente o Google, façam em seu sistema não passa despercebida pela comunidadeespecialmente o Google, ao seu sistema não passa despercebido pelo SEO

Em 2010, sabíamos que o Google tinha feito mais de 500 mudanças em seu algoritmo:

Esse número é muito superior desde que, só em 2018, a firma modificou seu algoritmo 3.234 vezes, ou seja, mais de 6 vezes.

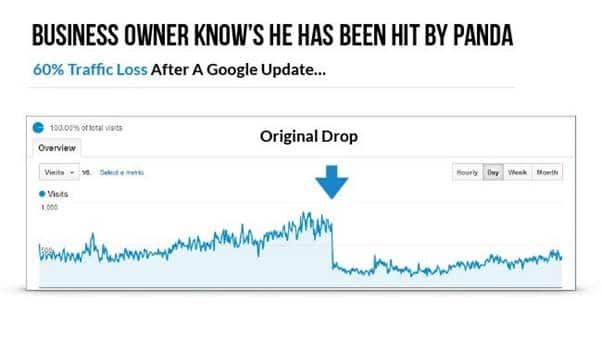

Obviamente, a maioria dessas atualizações é menor e seu impacto na classificação é insignificante. Portanto, não temos nada com que nos preocupar ?

Mas algumas mudanças, consideradas importantes, são facilmente perceptíveis devido ao seu efeito no ranking e no tráfego do site:

Fonte: Google

Esse é o caso da última e mais importante atualização do Google BERT.

Tendo em vista os efeitos de grandes atualizações, é bastante legítimo procurar conhecer as implicações do BERT do Google.

Portanto, e como meu artigo sobre RankBrainvou tentar mostrar

- O que é o Google BERT

- Como funciona o BERT e o problema que ele tenta resolver

- O impacto do BERT sobre a SEO

- As diferentes estratégias a adotar para otimizar seu website

Vamos!

Capítulo 1: O que é o BERT do Google?

1.1. BERT: O modelo de aprendizagem da máquina do Google

Alguns anos depois RankBraino Google está lançando outra atualização que ele descreve como muito importante: BERT.

Essa mudança foi feita pela primeira vez nos Estados Unidos, em outubro de 2019. Para outros países e idiomas, inclusive a França, terá que esperar até 9 de dezembro de 2019

Como esse tweet tenta assinalar, o BERT ajudará o algoritmo do mecanismo de busca a entender melhor as buscas, tanto no nível da consulta quanto no do conteúdo

Entretanto, é importante notar que o BERT não é apenas um algoritmo do Google, como se poderia imaginar

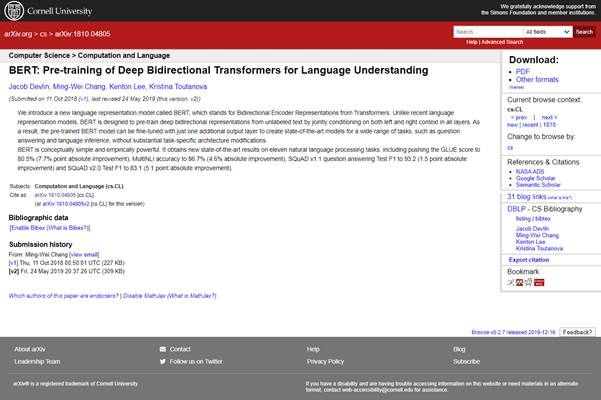

Na realidade, o BERT é também um projeto de pesquisa e um fonte aberta que foi publicado em outubro de 2018:

Google também diz em seu blog:

” Abrimos uma nova técnica de pré-treinamento de PNL chamada Representações de Encoder Bidirecional de Transformadores, ou BERT. Com este lançamento, qualquer pessoa no mundo pode treinar seu próprio sistema de resposta a perguntas de última geração (ou uma variedade de outros modelos) em cerca de 30 minutos em uma única TPU Cloud, ou em poucas horas usando uma única GPU. “

O senhor já pode ver que BERT significa “Bidirectional Encoder Representation from Transformers” (Representação de codificadores bidirecionais de transformadores)

Além disso, o BERT é um modelo de aprendizagem de máquina usado para considerar textos de ambos os lados de uma palavra

Oops! Parece que está ficando um pouco complicado com conceitos/termos técnicos

Não se preocupe, vou tentar explicar esses diferentes conceitos da maneira mais simples possível.

Note-se que o BERT é um modelo de aprendizado por máquina e, portanto, faz parte da IA ou inteligência artificial

E assim como o RankBrain, o BERT está em constante evolução graças aos modelos e dados que recebe.

1.2. BERT: A nova era do processamento da linguagem natural

O BERT tornou-se importante hoje porque acelerou significativamente a compreensão da linguagem natural para programas de computador

De fato, o fato de o Google ter tornado o BERT open source permitiu que todo o campo da pesquisa de processamento de linguagem natural melhorasse a compreensão geral da linguagem natural.

Isso, de fato, levou muitas grandes empresas de AI a construírem também versões do BERT

Assim, nós temos

- RoBERTa do Facebook

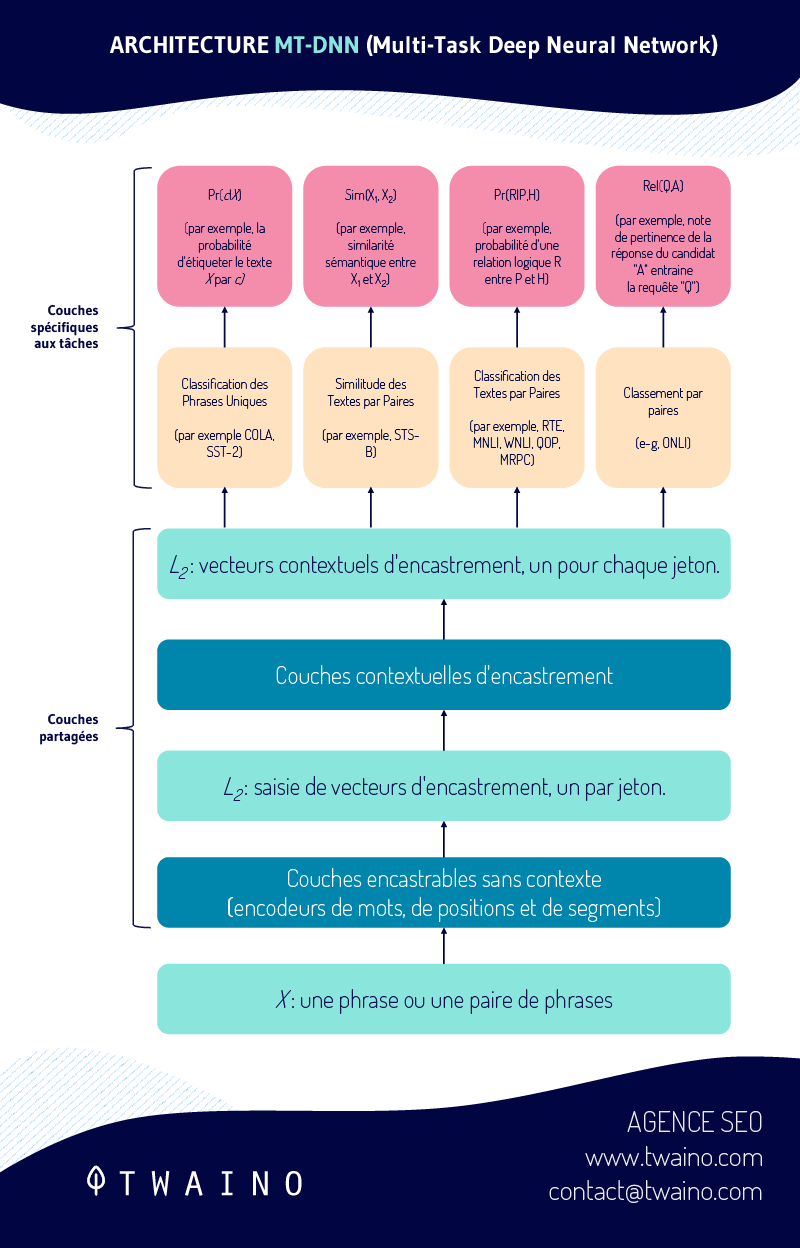

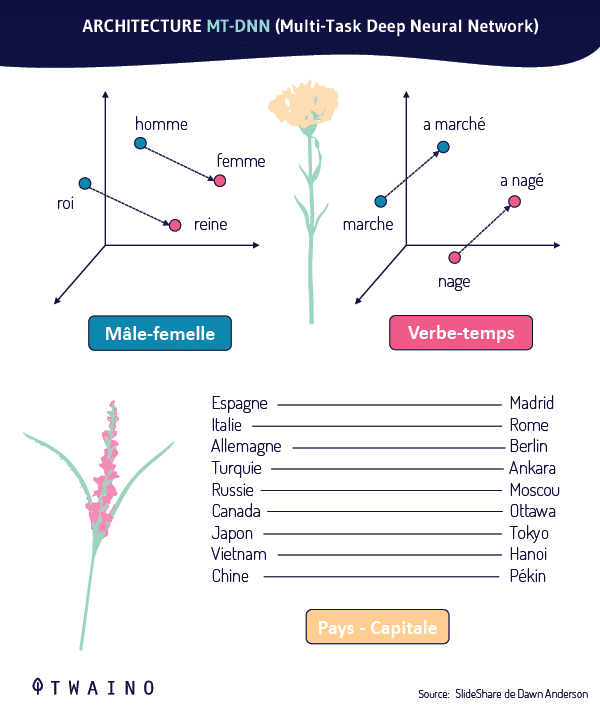

- Microsoft, que estende o BERT com MT-DNN (Multi-Task Deep Neural Network)

- SuperGLUE Benchmark para substituir o Benchmark GLUE

Por exemplo, há uma forma de BERT chamada Baunilha BERT ”

Isso proporciona uma camada inicial pré-treinada para modelos de aprendizagem de máquinas de línguas naturais. Isso proporciona uma base sólida para a melhoria contínua de sua estrutura. Especialmente desde que o Vanilla BERT foi pré-treinado no banco de dados da Wikipedia em inglês banco de dados.

Essa é uma das razões pelas quais o BERT é visto como o método que será usado para otimizar a PNL durante os próximos anos.

Para Thang Luongcientista de pesquisa sênior do Google Brain, BERT seria a nova era da PNL e provavelmente a melhor criada até agora:

Do acima exposto, deve ser entendido que o BERT não é usado exclusivamente pelo Google. Se o senhor pesquisou muito sobre o assunto, provavelmente descobriu que a maioria das menções ao BERT online NÃO são sobre a atualização do BERT do Google.

O senhor receberá muitos artigos sobre o BERT (que às vezes dão dores de cabeça por serem demasiado técnicos/científicos) escritos por outros pesquisadores. E que não usam o que podemos considerar como a atualização do algoritmo do Google.

Agora sabemos o que é o BERT e vamos falar sobre o seu funcionamento.

Capítulo 2: Como funciona o BERT do Google?

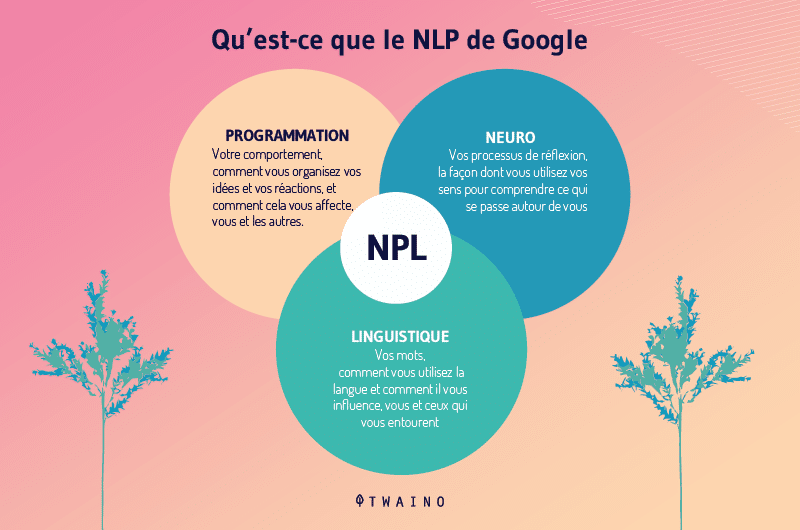

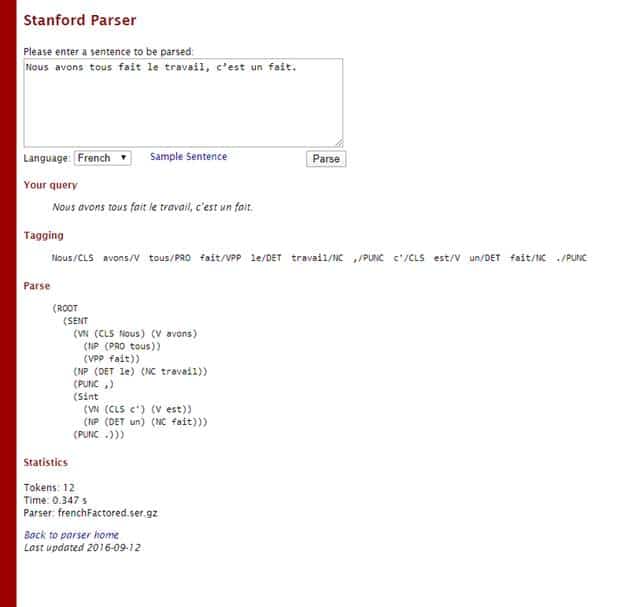

Para entender como o Google funciona, precisamos primeiro entender o conceito de NPL.

2.1. O que é o Google NLP e como ele funciona?

A comunicação entre os seres humanos e os computadores numa linguagem de som natural é possibilitada pelo PNL

NLP significa “Natural Language Processing” (Processamento de linguagem natural)

É uma tecnologia baseada na Inteligência Artificial que consiste no aprendizado automático da língua natural.

Esta tecnologia também é utilizada em

- Processadores de texto como o Microsoft Word Grammarly que usam NLP para verificar a precisão gramatical do texto;

- Os pedidos de tradução de idiomas, como o Google, traduzem;

- Aplicações de Resposta Interativa de Voz (IVR) usadas em centros de atendimento telefônico para responder a certos pedidos dos usuários;

- Assistentes pessoais, como OK Google, Hay siri, Cortana, Alexa..

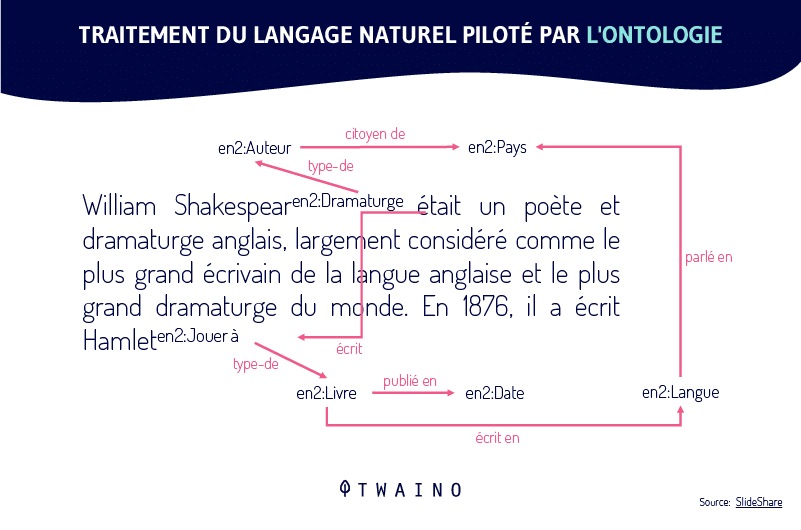

O PNL é a estrutura que permite o funcionamento do Google BERT e consiste em cinco serviços principais para realizar tarefas de processamento de linguagem natural.

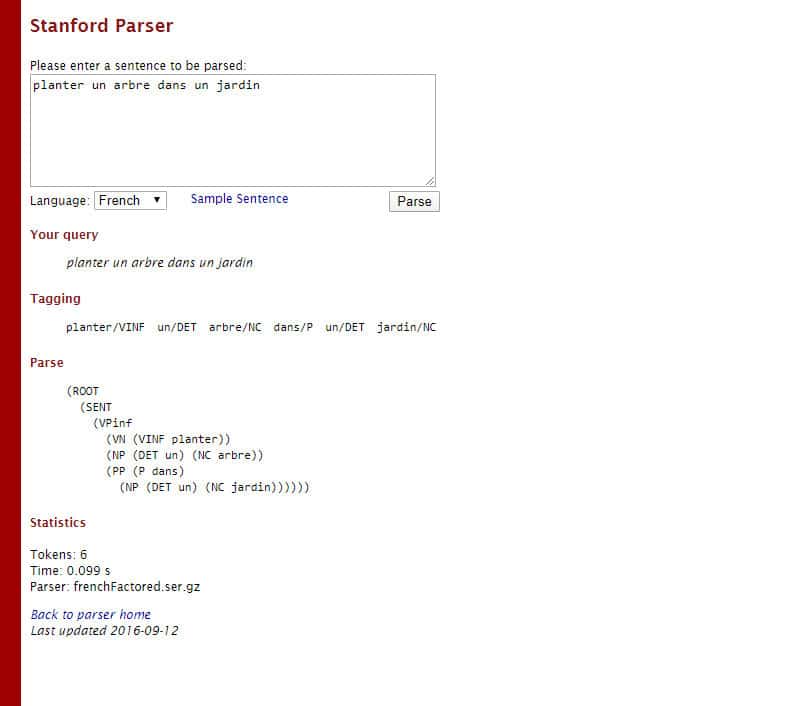

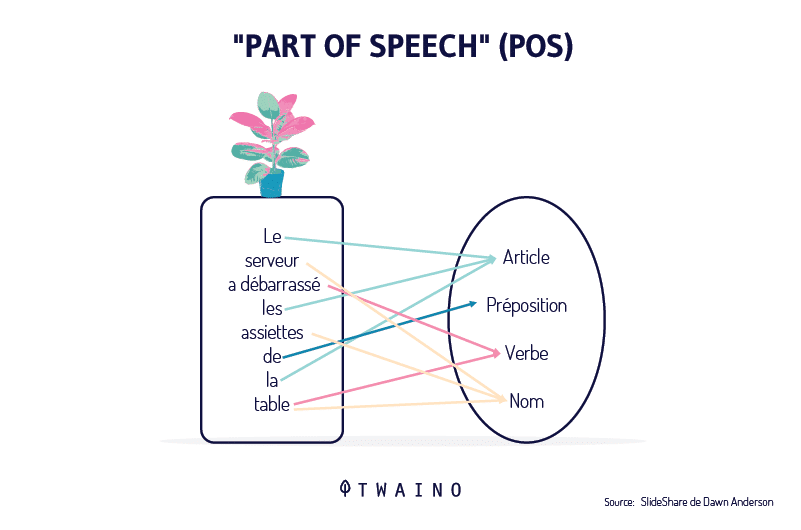

2.1.1. Análise sintáctica

Nessa análise, o mecanismo de busca divide a consulta em palavras individuais e depois extrai as informações lingüísticas.

Por exemplo, vamos fazer a seguinte pergunta: “Plantemos uma árvore num jardim”

Nessa pergunta, o Google pode decompor a pergunta da seguinte maneira

- Planta etiqueta verbo no infinitivo

- A etiqueta determinador

- Árvore etiqueta nome comum

- Em etiqueta preposição

- A etiqueta determinador

- Jardim etiqueta substantivo comum

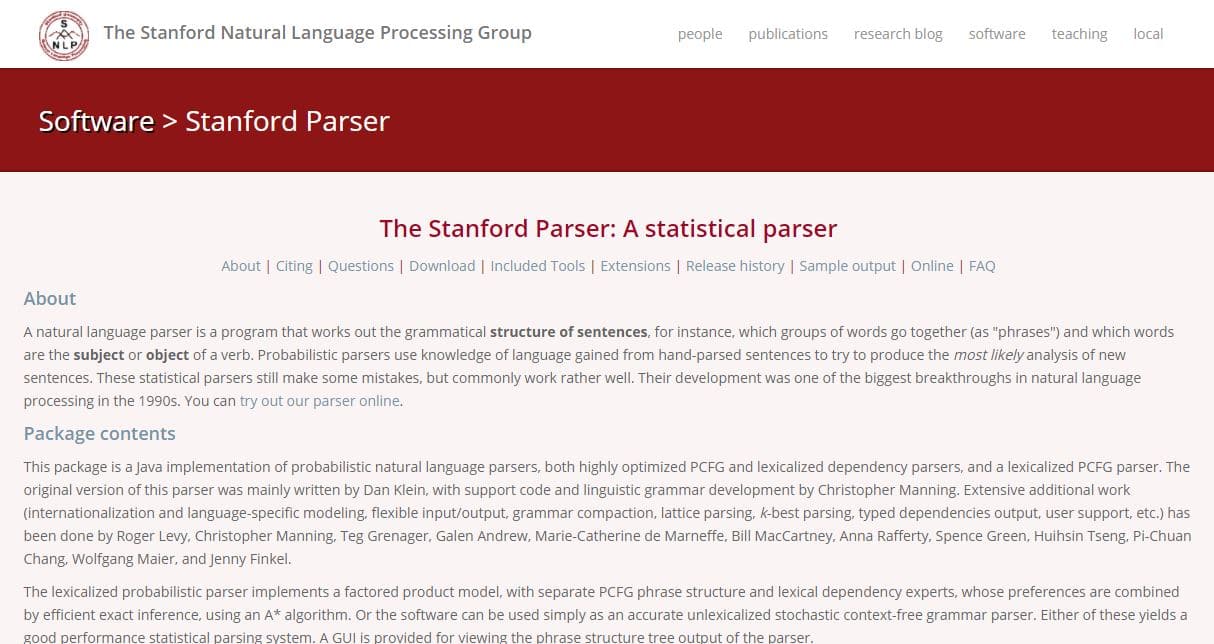

Como é o caso com o Stanford/Parceiro que é um analisador de língua natural:

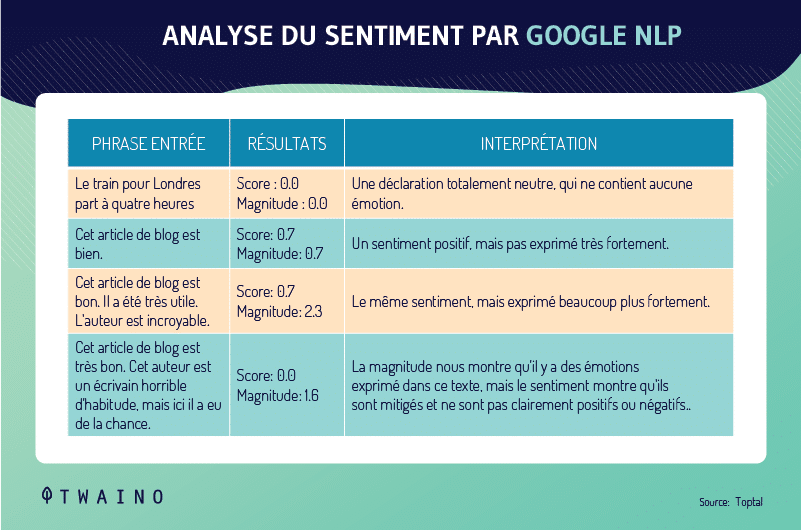

2.1.2. Análise dos sentimentos

O sistema de análise dos sentimentos do Google atribui uma pontuação emocional à pergunta

O quadro seguinte mostra alguns exemplos de como funciona o conceito de análise de sentimentos pelo Google

Portanto, observe que os valores não são do Google e foram tomados ao acaso:

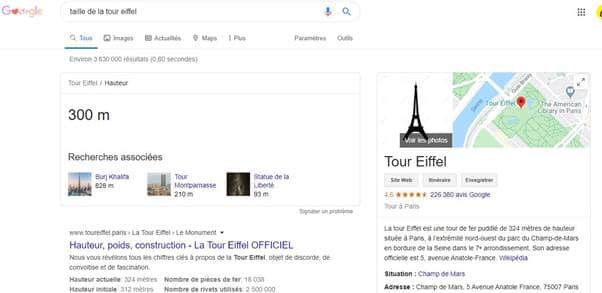

2.1.3. Análise das entidades

Aqui, o Google leva em conta as entidades que estão presentes nas consultas para apresentar informações sobre elas, na maioria das vezes com o Gráfico de Conhecimentos.

Se o senhor pesquisar por exemplo “tamanho da Torre Eiffel”, o motor de busca detectará “Eiffel” como uma entidade

Desse modo, enviará informações sobre essa pergunta

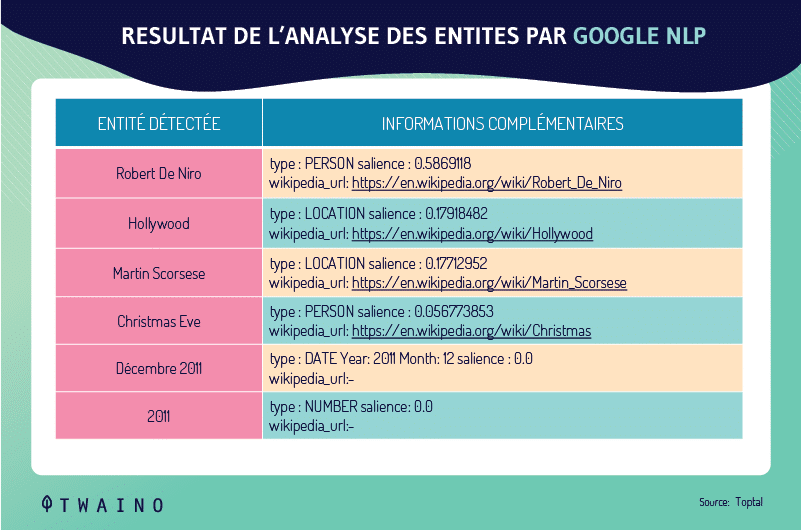

O Google pode classificar as coisas desta forma para este exemplo a partir de Toptal

“Robert DeNiro falou com Martin Scorsese em Hollywood na véspera de Natal, em dezembro de 2011”

2.1.4. Análise do sentimento da entidade

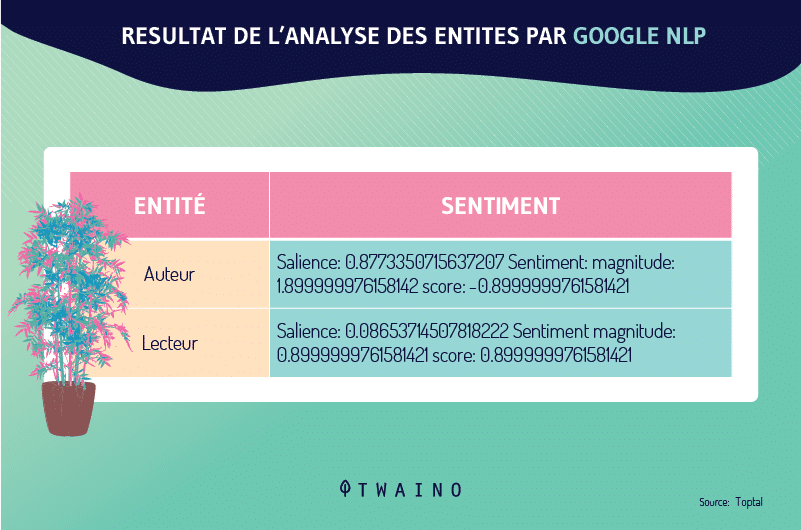

Semelhante à análise dos sentimentos, o Google tenta identificar o sentimento geral nos documentos que contêm as entidades.

Dessa maneira, o mecanismo de busca dá uma pontuação a cada uma das entidades com base na forma como são utilizadas nos documentos

Tomemos outro exemplo de Toptal

“O autor é um péssimo escritor. O leitor, por outro lado, é muito inteligente

2.1.5. Classificação do texto

O algoritmo do Google sabe exatamente a quais tópicos as páginas da web pertencem

Quando um usuário faz uma pergunta, o Google faz uma correspondência com a frase e sabe exatamente qual categoria de páginas da web está sendo pesquisada.

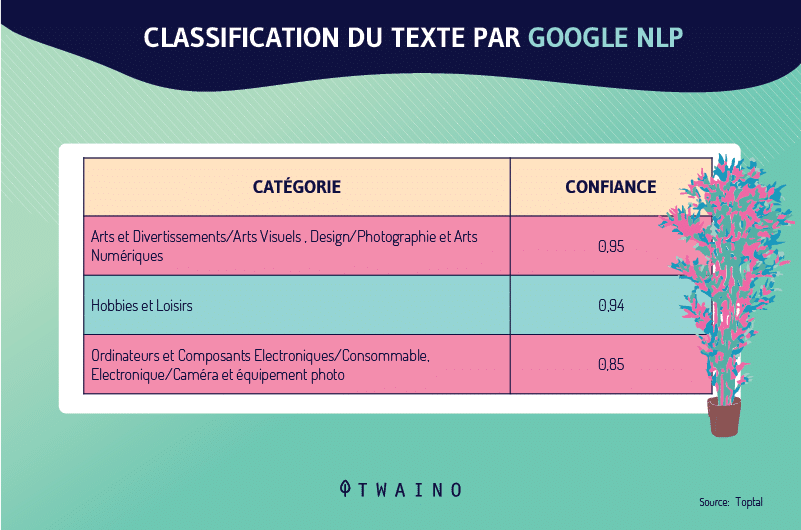

Aqui está outro exemplo da mesma fonte

Eles analisaram com o Google NLP API esta frase de um anúncio sobre a Nikon

” O grande sensor em formato D3500 de 24,2 MP DX captura fotos ricamente detalhadas e filmes Full HD – mesmo quando se filma com pouca luz. Combinado com o poder de renderização de sua lente NIKKOR, o senhor pode começar a criar retratos artísticos com fundo liso e borrado. Com facilidade. “

Traduzimos o que temos

” O grande sensor D3500 de 24,2MP DX capta fotos altamente detalhadas e vídeo Full HD, mesmo em condições de pouca luz. Combinado com o poder de renderização de sua lente NIKKOR, o senhor pode começar a criar retratos artísticos com fundo liso e borrado. Com facilidade. “

O resultado da classificação é o seguinte

Podemos ver que o teste é classificado como

- Artes e Entretenimento/Artes Visuais e Design/Fotografia e Artes Digitais com 0,95 como índice de confiança;

- Passatempos e lazer com um nível de confiança de 0,94

- Computadores & Eletrônicos/Câmeras eletrônicas de consumo com um nível de confiança de 0,85.

Esses são os 5 pilares do PNL do Google, que têm como um grande desafio a falta de dados.

Nas palavras de Google :

” Um dos maiores desafios no processamento de linguagem natural (PNL) é a falta de dados de treinamento. Como a PNL é um campo diversificado, com muitas tarefas distintas, a maioria dos conjuntos de dados específicos de tarefas contém apenas alguns milhares ou algumas centenas de milhares de exemplos de treinamento marcados pelo homem. “

Para resolver o problema da escassez de dados de treinamento, o Google foi um passo além e projetou o Google AutoML Linguagem Natural o que permite aos usuários criar modelos personalizados de aprendizagem de máquinas

O modelo BERT do Google é uma extensão da linguagem natural do Google AutoML. É por isso que a comunidade da PNL também pode usá-la.

2.2. Quais são os problemas que o BERT está tentando resolver?

Como humanos, podemos compreender facilmente algumas coisas que máquinas ou programas de computador são incapazes de compreender.

O BERT veio a corrigir esse problema à sua maneira e esses são os principais pontos que aborda:

2.2.1. Contagem de palavras e ambigüidade

Cada vez mais conteúdo está sendo divulgado na rede e nós estamos literalmente sobrecarregados

O número de palavras não é em si mesmo um problema para as máquinas que são projetadas para processar uma quantidade astronômica de dados.

Na verdade, as palavras são problemáticas porque muitas delas são

- Ambíguos e polêmicos: Uma palavra pode ter vários significados;

- Sinônimo: Palavras diferentes significam a mesma coisa.

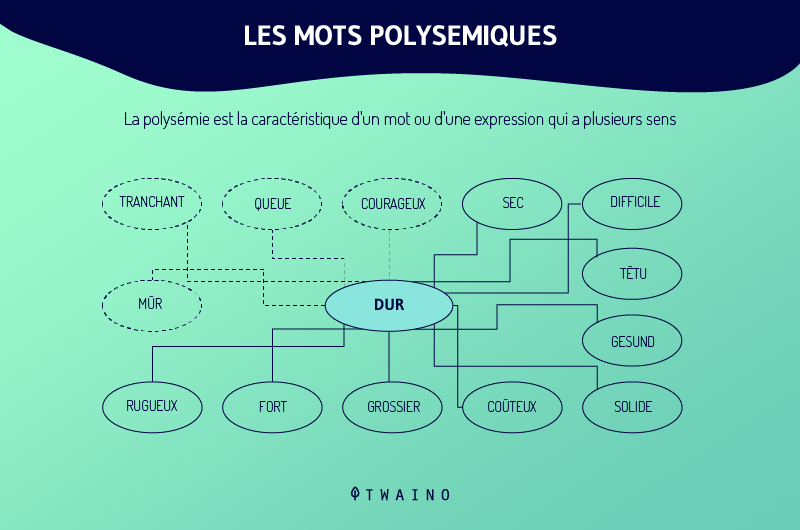

Bert foi concebido para ajudar a resolver sentenças e expressões ambíguas que são compostas de palavras polissêmicas.

O senhor concordará comigo que há muitas palavras que têm múltiplos significados

Quando escrevo a palavra “imã”, o senhor não sabe se é o material usado para atrair o ferro ou se é a conjugação do verbo “amar”.

Essa ambigüidade é perceptível por escrito ou por textos escritos, mas se torna muito mais difícil quando se trata de falar

De fato, mesmo o tom de voz pode fazer com que uma palavra tenha outro significado

Quando digo um insulto em tom amistoso a alguém próximo a mim, significa algo completamente diferente de quando insulto alguém em tom de raiva.

O primeiro provavelmente fará as pessoas rir, mas o segundo provavelmente me fará passar um mau bocado ?

Nós, humanos, temos uma capacidade natural de compreender facilmente as palavras que são usadas

Isso é algo que os computadores ainda não podem fazer perfeitamente. Isso levanta outro problema, muito mais importante:

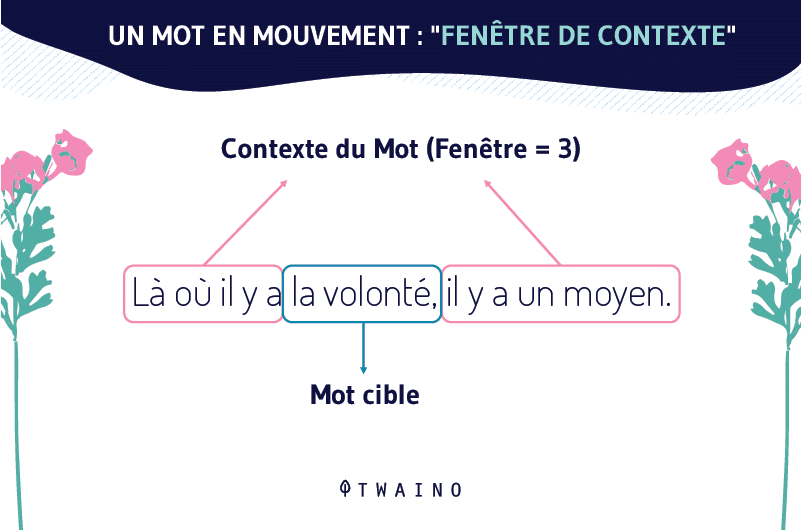

2.2.2. O contexto das palavras

Uma palavra só tem um significado preciso se for usada em um contexto particular

Na verdade, o significado de uma palavra muda literalmente à medida que uma sentença se desenvolve.

Vou dar um exemplo simples: “Todos nós já fizemos o trabalho, isso é um fato

Como seres humanos, temos a capacidade de saber rapidamente que as duas palavras “feito” são diferentes.

Vamos usar o programa de PNL mais uma vez Stanford Parser

Uma análise da minha sentença me dá esse resultado

O software foi capaz de distinguir entre “fato” como verbo particípio passado e “fato” como substantivo comum

Sem a NLP, teria sido difícil para os programas de computador fazer uma distinção clara entre esses dois termos.

Isso porque é o contexto, e particularmente as outras palavras da frase, que nos permitem compreender o significado exato das palavras.

Portanto, o significado da palavra “fato” muda de acordo com o significado das palavras que a rodeiam.

Obviamente, quanto mais longa for a sentença, mais difícil será seguir o contexto completo de todas as palavras da sentença.

Assim, à medida que mais conteúdo é gerado na rede, as palavras se tornam mais problemáticas e mais difíceis de serem compreendidas pelos motores de busca. Para não falar da busca conversa, que é muito mais complexa do que a palavra escrita.

O grande problema que o BERT resolve aqui é acrescentar contexto às palavras usadas para entendê-las.

O papel essencial do BERT é o de tentar SUBSTITUIR as palavras usadas.

Voltaremos a este assunto nas próximas seções deste guia. Por enquanto, vamos nos concentrar em outro aspecto da PNL, que é a diferença entre a NLU e a NLR.

2.3. A diferença entre o entendimento da língua natural (NLU) e o reconhecimento da língua natural (NLR)

O entendimento da língua natural é diferente do reconhecimento da língua natural

Os motores de busca sabem como reconhecer as palavras que seus usuários usam. Mas isso não significa que eles possam compreender as palavras no contexto

Na verdade, para estar ciente da linguagem natural, o senhor tem que usar de bom senso. Isso é muito fácil para os seres humanos, mas difícil para as máquinas

Por exemplo, como seres humanos, estamos acostumados a analisar vários fatores para compreender o contexto das palavras e, portanto, as informações que são veiculadas

Estes são, por exemplo

- As sentenças anteriores

- A pessoa com quem estamos conversando

- O cenário em que nos encontramos

- Etc.

No entanto, uma máquina não pode fazer isso tão facilmente, mesmo que possa reconhecer palavras em linguagem natural.

Por essa razão, podemos dizer que a NLU, BERT, permite que o Google tenha uma melhor compreensão das palavras que já está acostumado a reconhecer.

O mesmo se aplica aos dados estruturados e aos dados do Knowledge Graph, que têm muitas lacunas que a NLU preenche.

Poder-se-ia perguntar com razão: como os motores de busca podem preencher as lacunas entre as entidades nomeadas?

2.4. Desambiguação da linguagem natural

Nem tudo o que é mapeado para o gráfico de conhecimento é usado pelos motores de busca. É por isso que a desambiguação da linguagem natural é usada para preencher as lacunas entre as entidades nomeadas.

Ela se baseia na noção de co-ocorrência que fornece contexto e pode mudar o significado de uma palavra.

Por exemplo, o senhor esperaria ver uma frase como “site de referência” em um artigo sobre ligações em atraso. Mas ver uma frase como “moeda criptográfica” estaria fora de contexto.

É por isso que os modelos lingüísticos que são treinados em coleções muito grandes de textos precisam ser marcados com conjuntos de dados. Isso é feito usando a semelhança distributiva para aprender o peso e a medida das palavras e sua proximidade

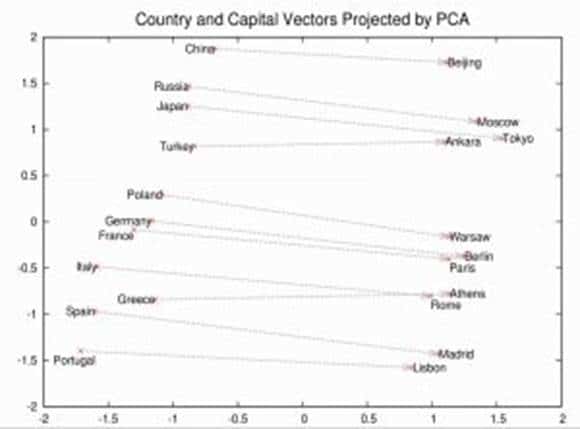

Aqui, o BERT é usado para realizar a tarefa de treinar esses modelos treinados para vincular conceitos e palavras:

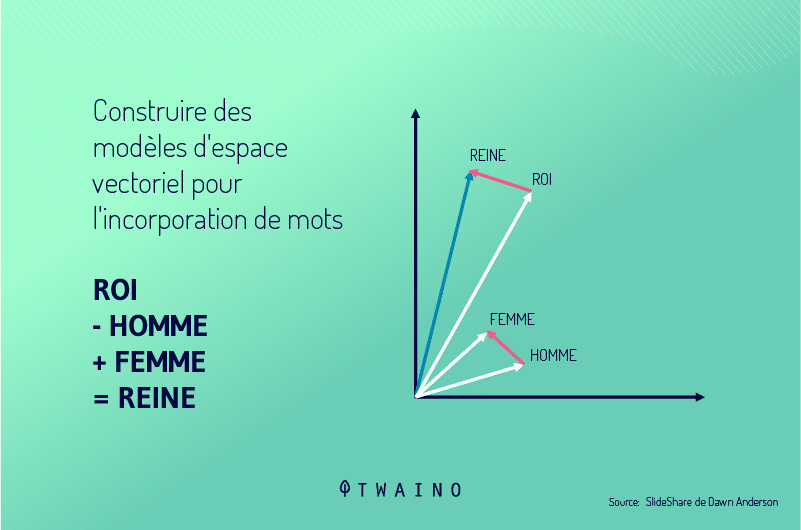

Usando esses modelos, as máquinas são capazes de construir modelos vetoriais de espaço para a incorporação de palavras:

2.5. Como o Google BERT fornece contexto às palavras

Uma única palavra só tem um significado semântico quando colocada em um determinado contexto

O BERT é então usado para assegurar a “coesão do texto”, ou seja, para manter uma certa coerência no texto

Quando se fala de coesão, há apenas um fator que dá sentido a um texto O elo gramatical

Uma parte importante do contexto semântico é a marcação de parte da fala (POS):

Tivemos que mencionar isso na seção sobre PNL! O senhor se lembra disso, não se lembra?

Agora vamos dar uma resposta à seguinte pergunta:

2.6. Como funciona o Google BERT?

Os antigos modelos linguísticos, como o Word2Vec, que vimos no RankBrain não integram as palavras com seu contexto:

É precisamente isso que o BERT tenta fazer para que os motores de busca possam fazer.

Veremos como funciona e, para isso, desconstruiremos a própria sigla do BERT: Bidirectional modelling Encoder Representations Transformers

2.6.1. O B no BERT: Bidirecional

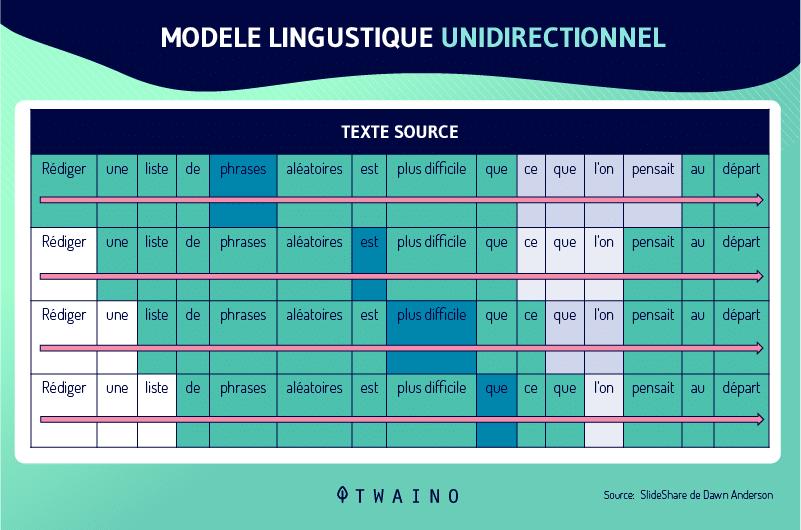

Os modelos lingüísticos costumavam ser unidirecionais na tentativa de compreender o contexto das palavras

Em outras palavras, eles só poderiam mover a janela de contexto em uma direção, para compreender o contexto da palavra

Tomemos este exemplo para entender melhor: “Eu já consumi o conteúdo que é publicado”

Os modelos lingüísticos só podiam ler a frase em uma direção para tentar compreender o contexto. Isso significa que eles não poderão usar as palavras “consumidas” em ambos os sentidos, para saber que essa palavra significa, nesse nível, consultar / levar em conta.

É por isso que dizemos que a maioria dos modeladores de línguas são unidirecionais e só podem escanear palavras em uma direção. Isso pode fazer uma grande diferença na compreensão do contexto de uma sentença.

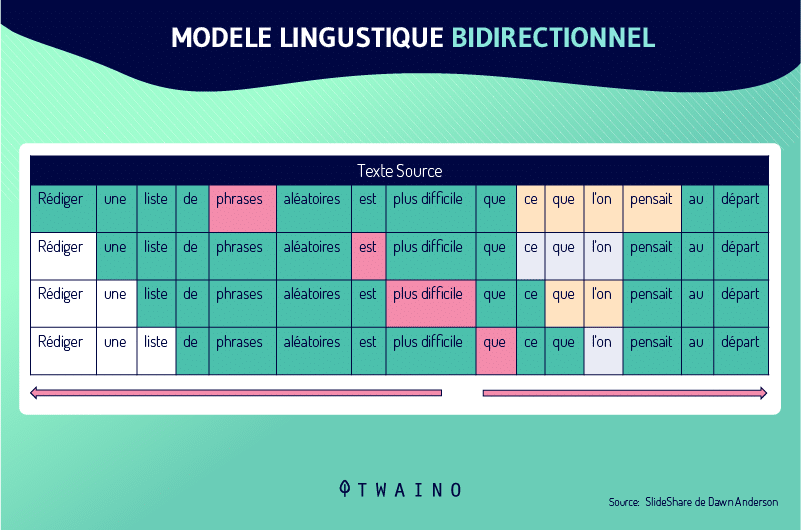

Em contraste, o BERT usa a modelagem bidirecional e pode ver ambos os lados de uma palavra alvo para colocá-la em contexto:

O BERT é o primeiro a ter essa tecnologia, o que lhe permite ver a frase inteira de ambos os lados de uma palavra para obter o contexto completo:

Google aponta neste trabalho de pesquisa intitulado “BERT: Pré-treinamento de Transformadores Bidirecionais Profundos para a Compreensão do Idioma”:

” O BERT é o primeiro modelo de representação baseado em afinação que atinge o desempenho máximo em um amplo conjunto de tarefas de nível de sentença e de nível simbólico, superando muitas arquiteturas de tarefas específicas…. É conceitualmente simples e empiricamente poderoso. Atinge novos resultados máximos em onze tarefas de processamento de linguagem natural, incluindo aumento da pontuação GLUE para 80,5% (7,7% de melhora absoluta), precisão MultiNLI para 86,7% (4,6% de melhora absoluta), pergunta F1 SQuAD v1.1 respondendo a 93,2 (1,5 ponto de melhora absoluta), e teste F1 SQuAD v2.0 para 83,1. “

Acabamos de ver o significado do “B”, vamos continuar com o

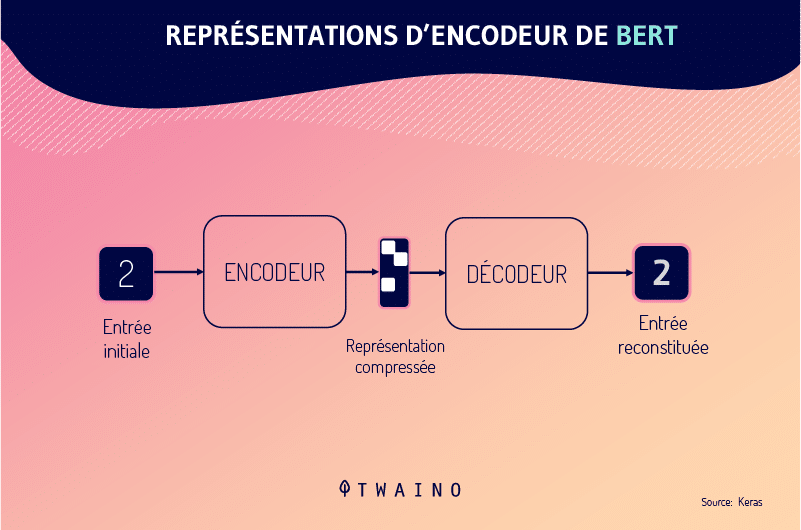

2.6.2. BERT’s ER: Representações dos codificadores

A representação do codificador é essencialmente o ato de alimentar o codificador com frases, de modo que descodificadores, modelos e representações saiam, dependendo do contexto de cada palavra.

Não creio que haja mais nada a dizer, passemos à última letra da sigla:

2.6.3. O T no BERT: Transformadores

O BERT usa “Transformers” e “Masked Language Modelling”.

Na verdade, outro problema importante encontrado em linguagem natural foi compreender a quem/que contexto uma palavra em particular se refere.

Por exemplo, às vezes é complicado seguir quem está sendo mencionado quando se usa pronomes em uma conversa. Especialmente quando se trata de uma conversa muito longa!

Esse problema não falta nos programas de computador. E é um pouco o mesmo para os motores de busca, eles têm dificuldade em acompanhar quando o senhor usa os pronomes

- Ele/eles

- Ela / Eles

- Nós

- Que ;

- Etc.

É dentro desse quadro que os transformadores se concentram nos pronomes e no significado de todas as palavras que vão juntas. Isso lhes permite relacionar quem está sendo falado ou o que está sendo falado com um determinado contexto.

Os transformadores são todas as camadas que formam a base do modelo do BERT. Eles permitem ao BERT não só olhar para todas as palavras de uma frase, mas também concentrar-se em cada palavra individual e examinar o contexto a partir de todas as palavras ao seu redor.

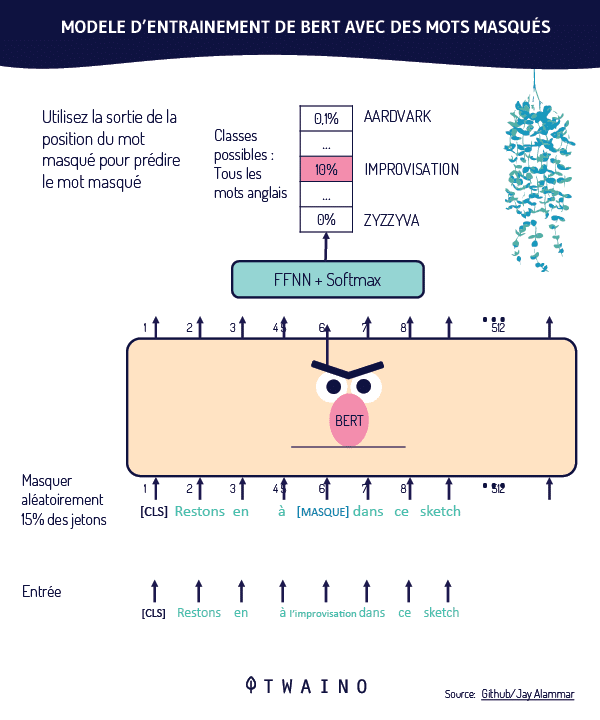

O BERT usa transformadores e modelagem de linguagem mascarada, o que significa que algumas palavras de uma frase são “mascaradas”, obrigando o BERT a adivinhar certas palavras

As palavras são mascaradas aleatoriamente e o BERT é obrigado a prever o vocabulário original das palavras com base apenas em seu contexto.

Isso também faz parte do processo de desenvolvimento do modelo.

Capítulo 3: Estudos de caso: Como o BERT realmente melhora os SERPs?

Para entender como o Google BERT funciona, usaremos os exemplos que o Google tem fornecido em seu artigo sobre o BERT.

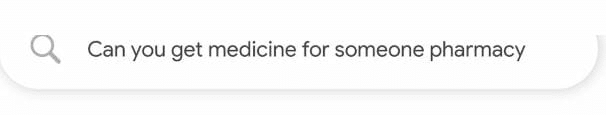

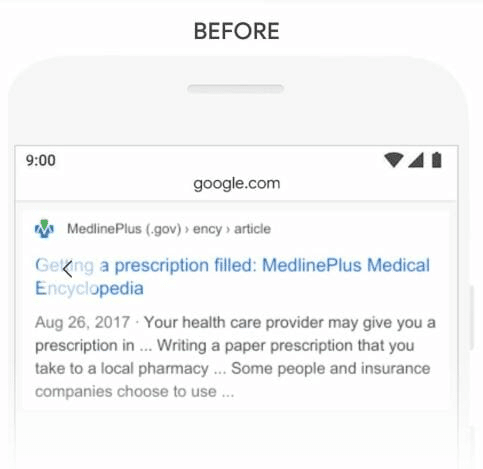

Exemplo 1: O significado da palavra “alguém

A pergunta que é considerada é a seguinte

Traduzido literalmente, temos: “O senhor pode conseguir remédios para alguém da farmácia”

Embora isso não seja muito preciso, pode-se entender que o usuário está tentando determinar se um parente do paciente pode pegar uma receita em seu nome.

Antes da integração do BERT em seu algoritmo, o Google deu esse tipo de resposta

Traduzido, temos a seguinte resposta

“Seu provedor de saúde pode lhe passar uma receita em … Escreva uma receita de papel que o senhor leva a uma farmácia local… Algumas pessoas e companhias de seguros optam por usar …”

Essa resposta é claramente insatisfatória, pois ignora que “alguém” que não é o paciente

Em outras palavras, o Google não foi capaz de processar o significado da palavra “alguém” no contexto da pergunta.

Depois do BERT, o Google parece ser capaz de captar as sutilezas das consultas que processa

Aqui está a resposta que o Google agora dá a essa pergunta

Traduzido para o francês, temos

“Um farmacêutico pode usar seu julgamento profissional e sua experiência de prática atual para … no melhor interesse do paciente, permitindo que uma pessoa que não seja o paciente pegue uma receita médica

Pode-se concordar que essa resposta é explícita e responde sem ambigüidade ao pedido do pesquisador.

Em outras palavras, o Google agora entendeu o significado semântico da palavra “alguém”, sem o qual a frase adquire um significado completamente diferente

Qual era, então, o papel do BERT nessa tarefa? Está acordado que o BERT ajudou o Google a entender a pergunta.

De fato, o Google conseguiu agora identificar as palavras mais importantes da pergunta através do contexto e dar-lhes uma certa classificação de importância durante o processamento

Isso tem permitido ao Google fornecer resultados de pesquisa muito mais precisos.

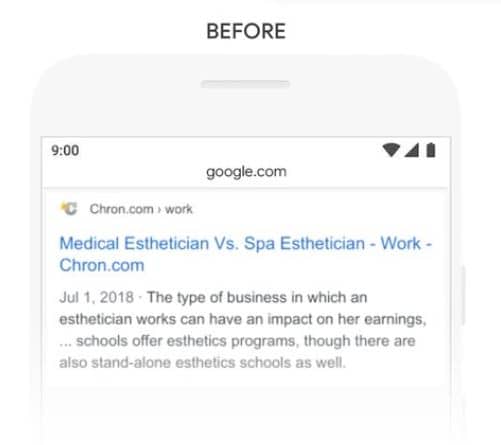

Exemplo 2: Consideração da palavra “levantar

A seguinte pergunta

Traduzido, temos

“Os esteticistas trabalham muito”

Antes do BERT, o Google dá essa resposta

Traduzido, temos

“o tipo de negócio para o qual uma esteticista trabalha pode ter um impacto em sua renda, … as escolas oferecem programas de esteticistas, embora também existam escolas de esteticistas independentes”

A resposta realmente não tem nada a ver com a pergunta do usuário

O Google interpretou erroneamente o termo “stand” ligando-o à expressão “stand-alone”.

Por essa razão, o Google chegou a um resultado que se referia ao auto-emprego de esteticistas.

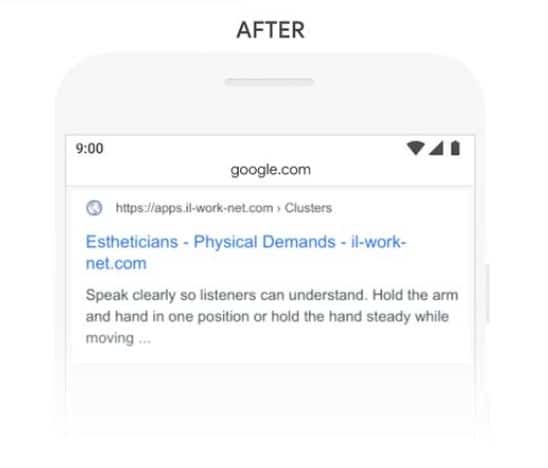

Com Bert, o Google está ficando um pouco mais inteligente e é capaz de compreender o contexto da pergunta:

Traduzido para o francês

“Fale claramente para que os ouvintes possam entender”. Segure seu braço e sua mão em uma posição ou segure sua mão direita enquanto se move”..

Aqui, o Google lista o esforço físico que as esteticistas devem fazer como parte de seu trabalho

A resposta à pergunta “as esteticistas trabalham muito” tem uma resposta melhor.

É exatamente isso que o Google indica

” Anteriormente, nossos sistemas adotaram uma abordagem de correspondência de palavraschave, que combinava o termo “autônomo” no resultado com a palavra “stand” na pergunta. Mas esse é o uso errado da palavra “levantar” no contexto. Nossos modelos do BERT, por outro lado, entendem que a palavra “stand” está relacionada com o conceito das exigências físicas de um trabalho e mostra uma resposta mais útil. “

Exemplo 3: O contexto da palavra “adultos

Como terceiro exemplo, temos esta pergunta:

Traduzido para o francês, temos

“Livro de práticas matemáticas para adultos”

Aqui, podemos assumir que o usuário pretende comprar livros de matemática para adultos

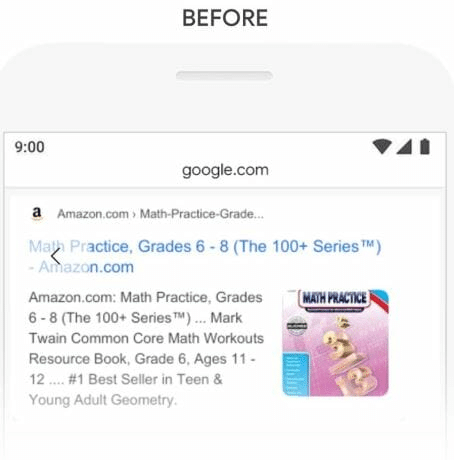

A resposta que o Google propôs diante do BERT é a seguinte

A descoberta é que o Google retorna resultados sugerindo livros para crianças, especialmente as séries 6-8

O Google forneceu essa resposta porque a página contém a frase “jovem adulto”

Mas, em nosso contexto, apenas as palavras correspondentes não funcionam e obviamente “jovem adulto” não é relevante para a pergunta.

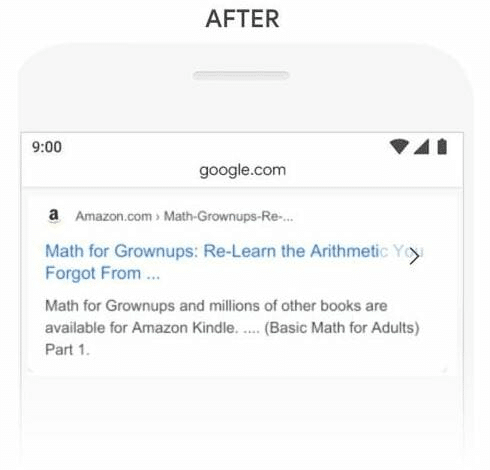

Depois do BERT, o Google é capaz de discernir corretamente a diferença entre as duas frases “jovens adultos” e “adulto”

Ou compreende o contexto em que essas duas expressões são usadas e exclui respostas fora do contexto:

Traduzido para o francês

“Matemática para Adultos (adultos) e milhões de outros livros estão disponíveis para o Amazon Kindle. … (Matemática Básica para Adultos) Parte 1

Exemplo 4: Considerando a palavra “sem

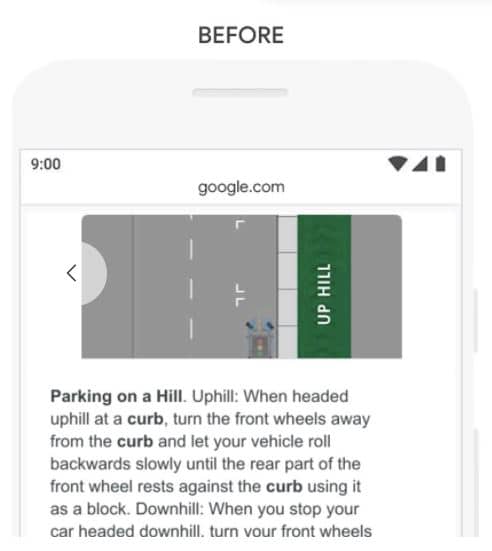

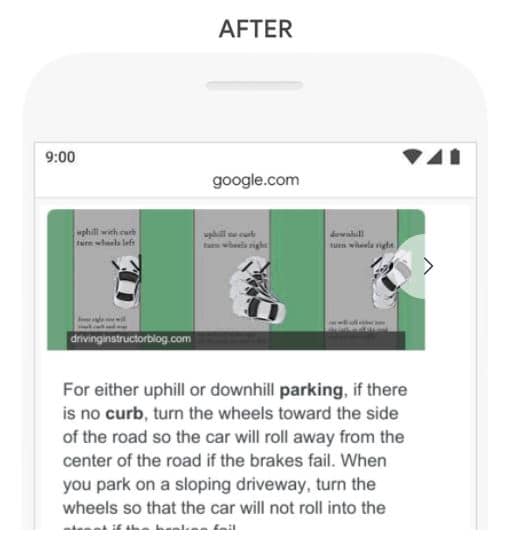

Considere outro exemplo em que o Google ignora uma preposição muito importante

Traduzido para o francês

“Estacionamento em uma colina sem calçada”

Aqui está a resposta que o Google propõe perante o BERT

Traduzido, temos

” Estacionamento em uma colina. Uphill: Ao subir um morro, vire as rodas dianteiras para longe do lancil e deixe seu veículo rolar lentamente para trás até que a parte traseira da roda dianteira encoste no lancil, usando-o como bloco. Descer : Quando o senhor parar seu carro em uma descida, vire as rodas. “

Pode-se ver que o Google deu demasiada ênfase à palavra “kerb”, ignorando a palavra “sem”

O Google provavelmente não entendeu o quanto essa palavra era essencial para responder corretamente a essa pergunta

Assim, devolveu resultados para o estacionamento em uma colina com um pavimento

Bert parece resolver esse problema, pois o mecanismo de busca compreende melhor a pergunta e o contexto.

Traduzimos o que temos

” Para estacionamento nas subidas e descidas. Se não houver berma, vire as rodas para o lado da estrada, de modo que o carro se afaste do centro da estrada se os freios falharem. Ao estacionar em um caminho inclinado, vire as rodas para que o carro não role para dentro do.. “

Como o senhor pode ver, o Google deu uma resposta muito boa para a pergunta em questão.

Neste momento, o senhor tem uma melhor compreensão do BERT do Google. Vejamos como o senhor pode otimizar seu website para uma boa SEO na época do BERT.

Capítulo 4: Como otimizar seu website para o Google BERT?

Otimização dos motores de busca é a otimização da visibilidade de um site nos motores de busca

Portanto, quaisquer atualizações que os motores de busca façam em seus algoritmos influenciam o processo de classificação

4.1. Qual é o impacto do BERT sobre a SEO?

O ponto mais óbvio, e que decorre de tudo o que discutimos até agora, é que O BERT ajuda o Google a entender melhor a linguagem humana.

O BERT é capaz de detectar nuances na linguagem humana natural, o que fará uma grande diferença para a maneira como o Google interpreta as consultas.

A firma estima que esta mudança afetará 10% de todas as consultas, tais como Google está tentando deixar claro

” Na verdade, quando se trata de classificar os resultados, o BERT ajudará a Search a compreender melhor uma em cada dez buscas nos Estados Unidos em inglês, e vamos expandi-lo para outros idiomas e localidades ao longo do tempo. “

Como RankBrain, Google pretende tratar principalmente de questões de forma longa e conversa com o BERT

” Especialmente por mais tempo e mais conversa perguntas mais longas, mais conversativasou pesquisas em que preposições como “para” e “para” são importantes para o significadoa pesquisa poderá compreender o contexto das palavras de sua pergunta. O senhor pode conduzir sua busca de uma maneira que lhe pareça natural. “

O mecanismo de busca também tem a intenção de captar dúvidas nas quais as preposições ou quaisquer outras palavras ambíguas são importantes para a compreensão do significado da sentença.

O que ter em mente O BERT é uma atualização poderosa que o Google usa para melhor processar as consultas a fim de apresentar os melhores resultados possíveis a seus usuários.

Obviamente, uma interpretação diferente / uma melhor compreensão das perguntas leva o Google a dar outras respostas em vez daquelas que costumava dar.

Muitas pessoas se queixam do impacto em suas classificações e outras viram, previsivelmente, sua classificação melhorar.

Com o BERT, o Google é capaz de determinar se as páginas que classificou para certas consultas são relevantes ou não.

Se assim for, poderia rebaixá-los e colocar em seu lugar outras páginas que considere muito mais apropriadas.

E a tão esperada pergunta :

4.como o senhor otimiza seu website para o Google BERT?

Podemos descrever o BERT, mas a pergunta mais importante é o que o senhor pode fazer para otimizar seu website para o BERT.

Para isso, vamos nos referir a Danny Sullivan, de quem falei muito no meu artigo sobre RankBrain

Ele é o contato do Google com o público, o que significa que ele ajuda as pessoas a entender melhor a pesquisa e ajuda o Google a entender melhor o feedback do público.

Sua resposta à pergunta é bastante simples

Traduzido para o francês, temos

” Não há nada a ser otimizado com o BERTnem nada para repensar para ninguém. Os princípios fundamentais que nos levam a premiar o “grande” conteúdo permanecem inalterados… Minha resposta foi que o BERT não muda os princípios fundamentais do que vimos dizendo há muito tempo: escrever conteúdo para os usuários. O senhor ou qualquer pessoa que trabalhe com clientes pode dizer há muito tempo que é isso que temos vindo a dizer. “

O que Danny está realmente assinalando é que não há nada que o senhor devesse fazer a partir de hoje que não devesse ter feito antes do BERT

Como o RankBrain, o Google BERT permite que o Google entenda melhor as consultas

Por exemplo, ele não avalia o conteúdo como um algoritmo que analisa a velocidade de carregamento do site para classificá-los

Portanto, otimizar para o BERT é tudo sobre : Conteúdo de qualidade de escrita para os usuários.

Não há dúvida de que o Google tem se concentrado no conteúdo nos últimos anos e creio que suas próximas atualizações vão no mesmo sentido.

Mas vamos tentar entender como otimizar a SEO de um site no contexto do BERT.

Penso que há dois aspectos principais a considerar ao otimizar seu conteúdo para esta grande atualização do Google

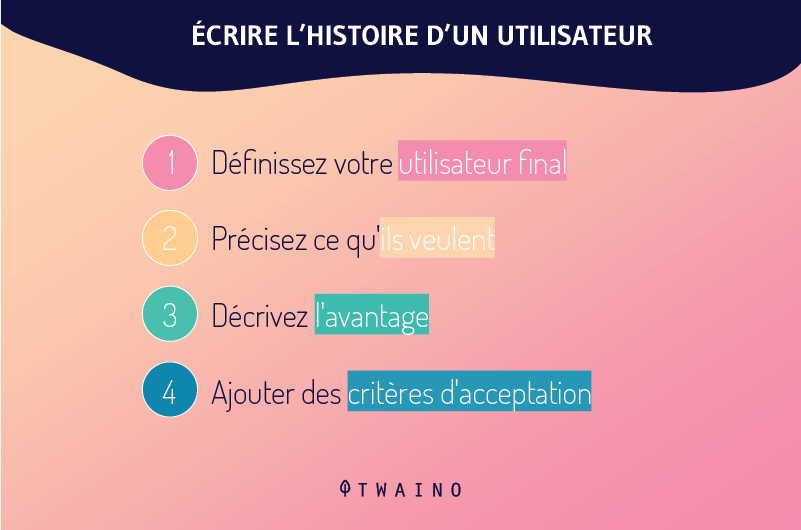

Otimização para o BERT: Identificar a intenção de busca de seus usuários

O BERT tenta entender melhor as dúvidas dos usuários ou ser mais preciso intenção de busca

Se as pessoas procuram, é principalmente porque têm uma necessidade a satisfazer

Nos exemplos dados pelo Google que vimos no capítulo anterior, foi necessário entender a intenção do usuário para poder dar uma resposta relevante.

Tomemos o primeiro exemplo: ” O senhor pode conseguir remédios para alguém na farmácia “.

Deve ser entendido que a intenção da busca é : Descobrir se é possível a um parente obter medicamentos da farmácia para um paciente

Ao ler a pergunta em uma linha, não é óbvio que se detecte essa intenção de busca. É por isso que é muito importante passar pela etapa de determinação da intenção de busca, uma vez que o senhor tenha palavras-chave.

Para descobrir a intenção de busca, o senhor precisa se fazer perguntas como, por exemplo

- Por que sua audiência está procurando usando palavras-chave particulares?

- O que eles estão tentando conseguir com sua busca?

- Eles estão tentando encontrar a resposta a uma pergunta?

- Eles querem chegar a um website específico?

- Eles querem fazer uma compra quando usam essas palavras-chave?

- E assim por diante.

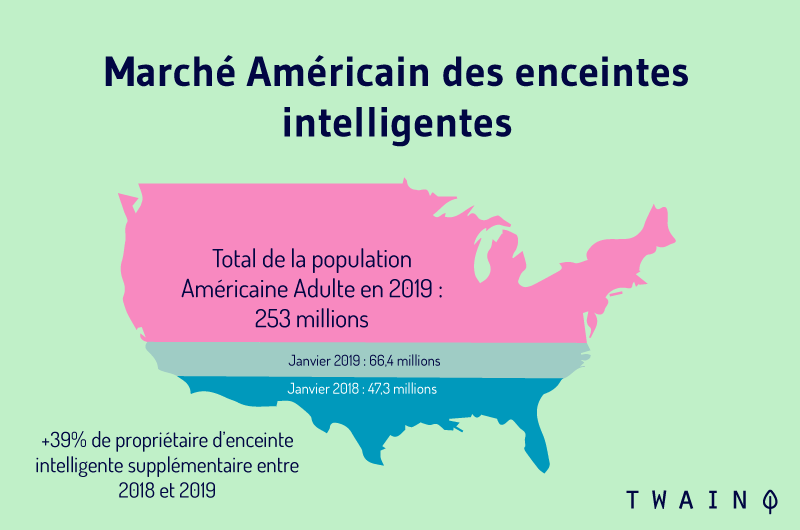

Com o uso crescente do celular e da busca por voz, em que as pessoas precisam de respostas rápidas e contextuais às suas perguntas, o Google está tentando se tornar cada vez mais capaz de determinar a intenção de busca das pessoas

Portanto, tenha em mente que todo o Google SERP está tentando agora corresponder melhor à intenção de busca e não à palavra-chave exata pesquisada

Nos últimos anos, o senhor verá que há situações em que o termo exato procurado não será sequer incluído na página de resultados de busca do Google. Digo isto por experiência própria e estou certo de que não estou sozinho.

Isso acontece porque o Google tem se tornado cada vez mais bom em determinar a intenção de busca das pessoas.

Abordei longamente este assunto, que o senhor encontrará em artigos como

O conteúdo que atender à intenção de busca será recompensado com o BERT do Google.

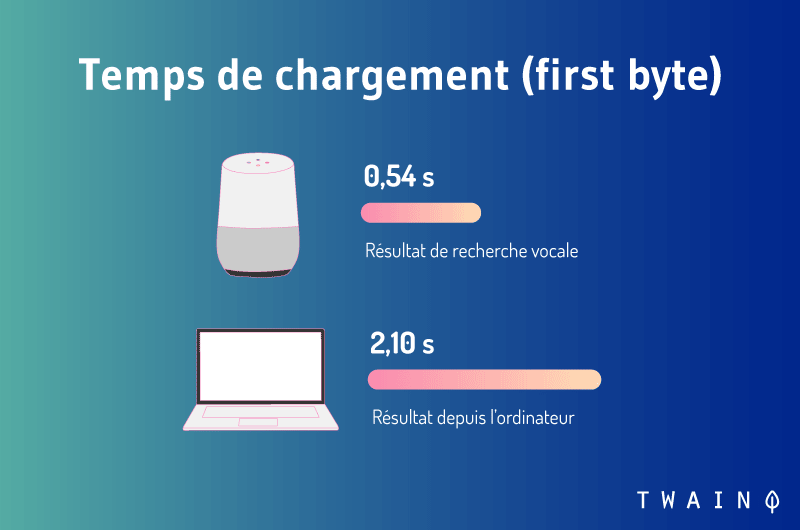

Otimização para o BERT: Pense na busca por voz e nos trechos destacados

O Google declarou que o BERT é para consultas longas e conversativas. E adivinhe em que tipo de busca esses dois elementos são normalmente encontrados: o Busca por voz.

Se o BERT lida principalmente com perguntas longas e linguagem natural, isso significa que permite ao Google lidar com uma boa parte das buscas de voz que geralmente são longas

Além da duração, as consultas são geralmente conversas

Assim como o senhor não pode dizer a seu amigo “Eiffel” para obter informações sobre esse monumento, não vai fazer isso com seu assistente de voz.

O senhor vai ser mais conversador ao fazer uma pergunta completa: “O que é a Torre Eiffel?

Com longas perguntas + conversas, o senhor usará todas as palavras para formular sua pergunta. Isso pode levá-lo a usar as preposições de que o Google fala, que às vezes são importantes

Conclusão A pesquisa de voz é o tipo de consulta que o Google quer tratar com o Google BERT.

Isso pode ser devido ao fato de que os usuários estão usando cada vez mais assistentes de voz para realizar buscas

O Google obviamente não quer perder essa revolução, que é muito mais exigente do que a pesquisa escrita clássica:

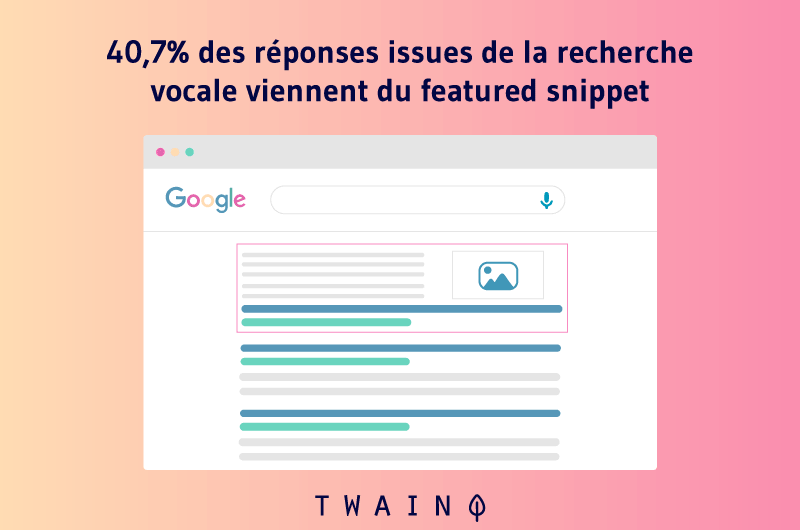

O senhor deve tentar otimizar seu conteúdo para a busca da voz, e uma das melhores maneiras de começar é pensar em um trecho destacado

O senhor deve compreender que os pesquisadores querem encontrar rapidamente o conteúdo que responda exatamente à sua pergunta

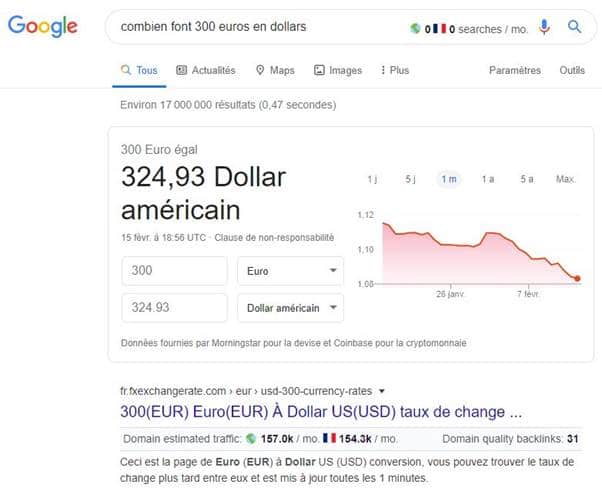

Se o senhor procurar por algo como “quanto é 300 euros em dólares”, obterá uma resposta direta no trecho em destaque

Com a atualização do BERT, o Google tem feito um esforço para mostrar trechos ainda mais relevantes.

Ver meu artigo sobre busca por voz para aprender algumas dicas úteis.

Vamos terminar nosso guia com algumas melhores práticas para a criação de conteúdo na época do BERT.

Capítulo 5: Algumas boas práticas a adotar no marketing de conteúdo na era do BERT?

O Google está dando cada vez mais crédito a conteúdo de alta qualidade e o senhor precisa se concentrar em escrever conteúdo que seja relevante para o usuário.

Se o senhor tiver conteúdo de baixa qualidade em seu site, talvez seja hora de limpá-lo ou atualizá-lo, pois ele pode não ter um bom desempenho com o Google BERT

O que nos leva à primeira prática

Prática 1: Faça a auditoria do conteúdo que o senhor publicou

Antes de o senhor começar a criar novos conteúdos, a melhor abordagem é auditar o conteúdo que publicou até agora

Esse passo permite principalmente ao senhor conhecer o conteúdo que mais tráfego traz para seu website e que lhe permite ocupar as melhores posições nos SERPs.

Uma vez determinado esse conteúdo, o senhor o avaliará para determinar se ele

- São naturais e não contêm palavras-chave com uma conotação mecânica;

- Responde às intenções dos usuários da Internet

- Estão otimizados para a busca de conversas

- São de qualidade suficiente para proporcionar um real valor agregado aos usuários da Internet

- Estão otimizados para o E-A-T

- Estão otimizados para o E-A-T; e assim por diante.

Com os recursos que enumerei até agora, o senhor provavelmente terá vários indicadores que analisará.

Essa ação permite ao senhor otimizar seu conteúdo para que não perca o posicionamento nos SERPs

Especialmente se o concurso tiver um conteúdo que ofereça uma experiência de usuário melhor do que a sua, o senhor terá um desempenho menos bom.

Assim, uma auditoria de conteúdo permite ao senhor reforçar e/ou melhorar a posição de seu conteúdo que já está funcionando bem nas SERPs.

É também uma oportunidade para descobrir conteúdos de má qualidade e para otimizá-los ou retirá-los se, em última análise, forem inúteis.

Dito isto, se o senhor acaba de lançar seu website, não deve esquecer o fato de que geralmente leva tempo para que seu conteúdo comece a ter um bom desempenho nos SERPs tempo para que seu conteúdo comece a desempenhar.

Para levar isto adiante, o senhor pode querer considerar uma auditoria completa da SEO ou tirar proveito do meu auditoria SEO gratuita.

Prática 2: Criar conteúdo autoritativo

Por definição, o marketing de conteúdo envolve a criação de conteúdo de alto valor para atrair e reter um público claramente definido

Como o Google entende melhor a linguagem natural, é claro que os escritores de conteúdo têm uma grande oportunidade de servir seus leitores com conteúdo que é escrito de uma maneira mais “humana”. E isso atende plenamente às intenções de busca dos buscadores

O BERT parece fazer o Google entender ainda melhor as perguntas do pesquisador, de modo que o senhor não tem desculpa

A criação de conteúdo autoritário é uma das estratégias mais eficazes para atrair o Google. A prova Toda a minha estratégia de criação de conteúdo se baseia exclusivamente no conteúdo sempre verde, o que me permitiu alcançar atualmente 6.000 visitantes por mês.

Ver meu artigo sobre a técnica do “one-upmanship para saber como criar tal conteúdo.

A dica mais importante é fazer uma análise SERP para descobrir o nível atual de qualidade do conteúdo presente nos resultados do Google.

Eu detalhei este processo em meu artigo sobre o 5 etapas para analisar o SERP, a fim de propor um melhor conteúdo

O senhor vai prestar atenção

- Os volumes de busca para as palavras-chave

- O tipo de classificação do conteúdo nas palavras-chave

- A dificuldade de classificação para essas consultas

- Os backlinks que ajudaram as páginas apareceram nos principais resultados do Google;

- Etc.

O senhor pode facilitar sua tarefa usando ferramentas como Moz, Ahrefs, Ubersuggest..

E se o senhor se pergunta por que precisa de uma ferramenta, eu lhe direi que uma ferramenta pode lhe dar muitas informações sobre o que seus usuários realmente estão interessados. Isso lhe permite escrever um conteúdo que realmente atenda às necessidades de sua audiência

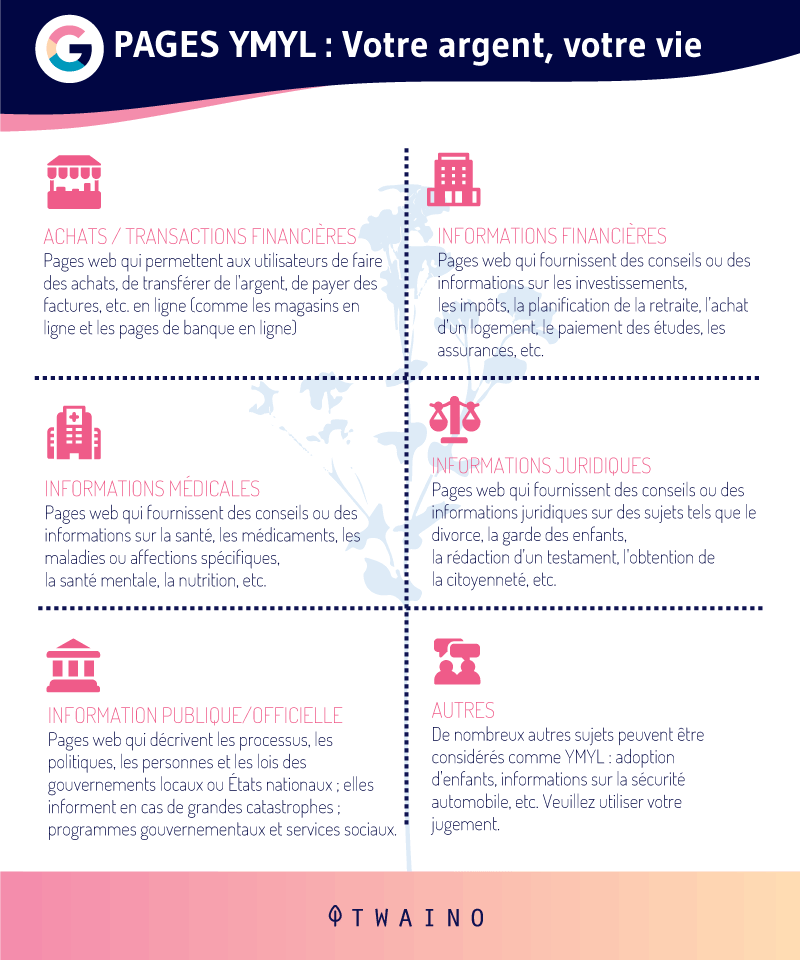

Prática 3: Otimize seu E-A-T (Perícia Autoritária e Fidedigna)

O Google está dando ênfase crescente ao conceito de E-A-T, especialmente para sites de YMYL

Esses são websites que têm um impacto na vida dos usuários da Internet:

Mas mesmo que seu website não se enquadre nessas categorias, é igualmente importante que se concentre no E-A-T.

O senhor pode estar se perguntando o que isso tem a ver com o BERT do Google?

Observe que o senhor pode criar conteúdo de qualidade, mas se lhe faltar autoridade ou confiabilidade na rede, o senhor pode ter um desempenho menos bom do que seus concorrentes.

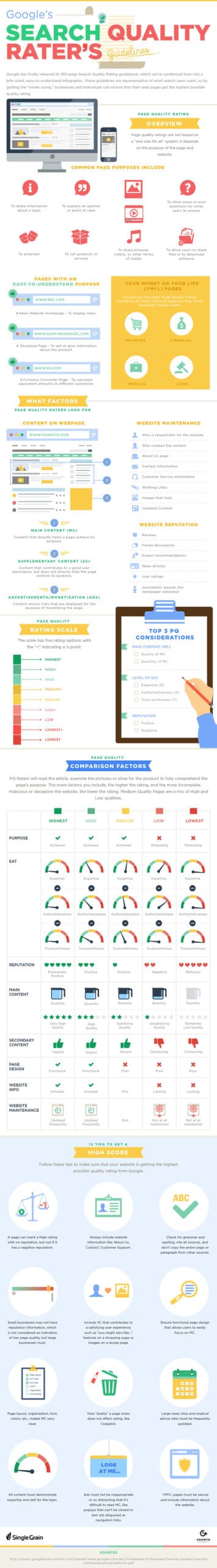

Portanto, pensar em otimizar seu website para E-A-T é uma das melhores estratégias de SEO:

E não há quase nada a acrescentar que o senhor já não saiba

Conclusão: BERT do Google – Seja natural na criação de seu conteúdo de alto valor

Desde seu início, o Google continuou a perseguir sua visão de entregar os melhores resultados aos seus usuários

Com isso em mente, o líder do mecanismo de busca acaba de acrescentar outra grande atualização à sua lista BERT

Como de costume, essa mudança não passou despercebida pela comunidade de SEO que precisa dominar o funcionamento dos mecanismos de busca para otimizar sua estratégia de SEO.

Neste artigo, procurei mostrar como o Google BERT funciona, evitando ao máximo termos técnicos. Infelizmente, não os evitei completamente ☹

Mas entendemos que o BERT é um modelo de aprendizado de máquina de código aberto que se apresenta como um grande avanço no campo do processamento de linguagem natural

O Google o usa para entender melhor as diferentes palavras nas consultas, principalmente por seu contexto. Um melhor entendimento que impacta 10% das consultas processadas pelo mecanismo de busca.

O único conselho que a firma dá é que se concentre em Criação de conteúdo de alta qualidade.

De fato, todas as últimas atualizações do Google tendem a favorecer o conteúdo que traz grande valor agregado aos usuários da Internet

Portanto, é mais do que nunca tempo de se concentrar exclusivamente na criação de conteúdo de alta qualidade

Tive a oportunidade de lhe dar algumas dicas que o senhor pode usar para aproveitar plenamente a era do Google BERT e provavelmente as próximas atualizações do Google.

O senhor quer, como de costume, muito trânsito, eu lhe digo

Até breve!